她把GPT-2“拆开看大脑”:一场关于语法藏在哪里的大胆实验

很多人以为,大语言模型只是靠“统计词频”在蒙答案。但在这场OpenAI Scholars Demo Day的演讲里,一位刚入行5个月的研究者,直接把GPT-2拆开,追问一个刺痛行业的问题:语法,究竟藏在模型的哪一层?答案,比你想象得更反直觉。

很多人以为,大语言模型只是靠“统计词频”在蒙答案。但在这场OpenAI Scholars Demo Day的演讲里,一位刚入行5个月的研究者,直接把GPT-2拆开,追问一个刺痛行业的问题:语法,究竟藏在模型的哪一层?答案,比你想象得更反直觉。

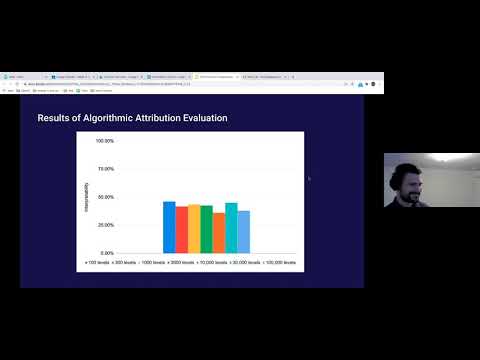

在 OpenAI Scholars Demo Day 上,一位工程师抛出了一个让人不安的问题:当模型性能不断提升时,我们真的更“理解”它了吗?他试图用量化指标回答“可解释性”这个长期依赖直觉和人工判断的问题,结果却比答案本身更耐人寻味。

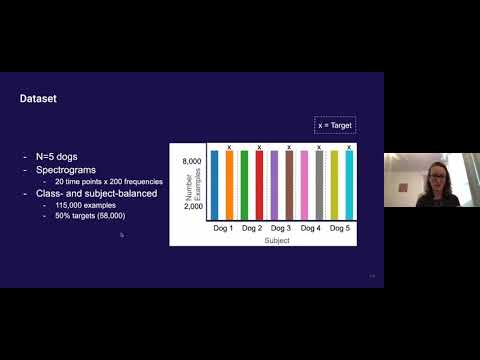

直到20年前,医学界还在争论一件事:癫痫发作到底能不能被预测?在 OpenAI Scholars Demo Day 上,一位神经科学出身的研究者用深度学习给出了一个并不完美、却足够震撼的答案——不仅能,而且很可能正是神经网络最擅长的那类问题。

在这次对话中,DeepMind研究者Matt Botvinick提出一个反直觉但极具启发性的观点:理解人类智能,不能只盯着大脑本身,还必须认真对待环境的结构。从图灵机隐喻到强化学习中的自我博弈,他勾勒出一条连接人类认知与现代AI的清晰线索。

在 OpenAI Scholars Demo Day 上,Christine Payne 做了一件反直觉的事:她没有发明全新的音乐模型,而是把“生成音乐”硬生生改造成一个语言模型问题。结果令人震惊——很多人已经分不清 AI 和人类作曲。但真正的挑战,才刚刚开始。

如果你不告诉模型什么是力、速度和动量,它还能理解世界吗?在 OpenAI Scholars Demo Day 上,Ifu Aniemeka 用一个看似“幼稚”的实验给出了惊人答案:只靠观察,神经网络真的能学会预测物体运动。这不是炫技,而是世界模型的一次重要试探。

大多数AI绘画在学“风格”,但Holly Grimm反其道而行:她把人类艺术课上的构图原则,直接塞进了CycleGAN的训练目标里。结果不是更像某位大师,而是第一次让模型“听懂”什么叫色彩和谐、纹理变化与构图控制。

这是一场关于通用人工智能(AGI)的长期思考者自述。Ben Goertzel回顾了科幻、人生经历、神经网络与现实技术的碰撞,解释他为何认为AGI并非遥远幻想,而是正在逼近的人类转折点。

Lex Fridman通过“苦涩教训”回顾了70年AI发展史,指出真正推动指数级进步的不是聪明算法,而是能持续放大算力的通用方法。视频从历史案例出发,讨论了算力、算法、数据与未来计算范式之间的张力。

这是一篇基于DeepMind研究员David Silver与Lex Fridman对话的深度文章,系统梳理了强化学习与深度强化学习的核心思想、方法分解,以及神经网络为何成为突破关键,同时保留了他对AI历史、未来与人类直觉局限的独特反思。