英语模型迁移到中文有多难?OpenAI一组Scaling Laws给了残酷答案

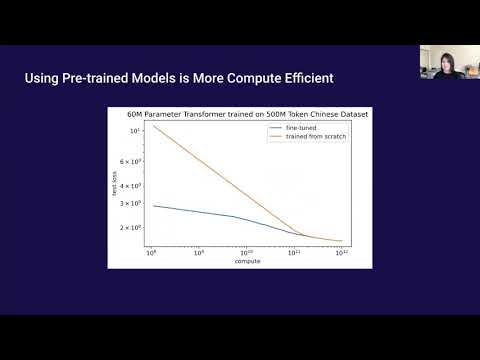

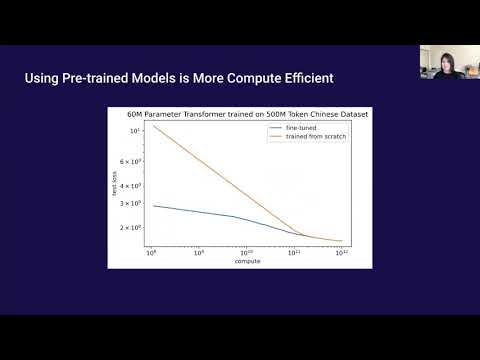

很多人直觉认为:只要模型够大、预训练够久,语言迁移自然水到渠成。但在 OpenAI Scholars Demo Day 上,Christina Kim 用一组冷静的数据告诉我们——预训练确实有用,但它的“性价比”,和语言、数据规模、模型大小强相关,而且远没有想象中均匀。

很多人直觉认为:只要模型够大、预训练够久,语言迁移自然水到渠成。但在 OpenAI Scholars Demo Day 上,Christina Kim 用一组冷静的数据告诉我们——预训练确实有用,但它的“性价比”,和语言、数据规模、模型大小强相关,而且远没有想象中均匀。

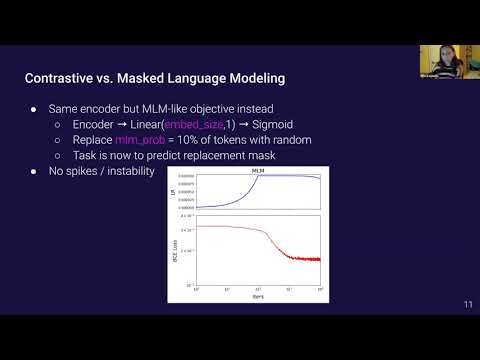

在计算机视觉里横扫榜单的对比学习,一搬到自然语言却问题频出。OpenAI Scholars Demo Day 上,Ellie Kitanidis 公开了一次并不“完美”的尝试:用对比学习预训练语言模型。真正的猛料不在结果,而在她暴露出的那个几乎所有语言模型都会撞上的隐形难题。

我们习惯相信:模型越大,效果越好。但在这场 OpenAI Scholars Demo Day 的分享中,一个关键前提被悄悄动摇——Scaling Laws 可能并不“公平”对待所有 Transformer 架构。Shola Oyedele 用一组克制却锋利的实验,揭开了架构选择背后的成本与收益真相。

在这期Lex Fridman播客中,强化学习奠基者之一Michael Littman回顾了从TD-Gammon到AlphaGo的关键转折,讨论了强化学习与Transformer浪潮的关系,并对通用人工智能的现实形态提出了冷静而反直觉的判断。

很多人以为,大语言模型只是靠“统计词频”在蒙答案。但在这场OpenAI Scholars Demo Day的演讲里,一位刚入行5个月的研究者,直接把GPT-2拆开,追问一个刺痛行业的问题:语法,究竟藏在模型的哪一层?答案,比你想象得更反直觉。

在 OpenAI Scholars Demo Day 上,Christine Payne 做了一件反直觉的事:她没有发明全新的音乐模型,而是把“生成音乐”硬生生改造成一个语言模型问题。结果令人震惊——很多人已经分不清 AI 和人类作曲。但真正的挑战,才刚刚开始。

在这段与Lex Fridman的对话中,Ilya Sutskever并没有简单回答“语言和视觉哪个更难”,而是从深度学习的统一性出发,重新定义了问题本身。他分享了对计算机视觉、自然语言处理和强化学习之间关系的深刻判断,以及未来AI可能走向“单一架构”的大胆预期。

MIT教授Vivienne Sze从能效视角重新审视深度学习、机器人与AI系统设计。她指出,算力增长背后隐藏着能耗与碳足迹危机,而真正的突破来自跨越算法、模型与硬件的协同设计。这是一场关于“把计算带回现实世界”的深度反思。

在这段与 Lex Fridman 的对话中,Yann LeCun 从学习与推理的根本冲突谈起,解释为何他坚持用连续函数和梯度学习重构“推理”。他借助人脑记忆结构、能量最小化与世界模型,描绘了一条不同于符号主义AI的长期路线。

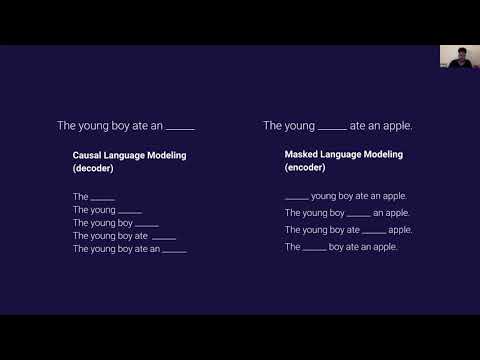

Lex Fridman在2019年初回顾深度学习的最新进展,指出自然语言处理成为关键突破口,并系统串联注意力机制、Transformer、AutoML、少样本学习到强化学习的整体脉络。这是一份理解现代AI如何走向通用能力的路线图。