马斯克亲自下场做AI:xAI不是挑战OpenAI,而是要改写游戏规则

Elon Musk 宣布成立 xAI 时,几乎没人知道它要做什么,但所有人都意识到:这不是一次普通的创业。前 OpenAI 创始人、手握 Twitter 数据、集结顶级研究员,xAI 背后是一套与主流完全不同的 AI 世界观。这篇文章带你拆解,xAI 真正想干什么,以及它为什么可能成为 OpenAI 最危险的对手。

Elon Musk 宣布成立 xAI 时,几乎没人知道它要做什么,但所有人都意识到:这不是一次普通的创业。前 OpenAI 创始人、手握 Twitter 数据、集结顶级研究员,xAI 背后是一套与主流完全不同的 AI 世界观。这篇文章带你拆解,xAI 真正想干什么,以及它为什么可能成为 OpenAI 最危险的对手。

如果你还认为“写代码”是少数工程师的专利,这场演讲会直接推翻你的认知。Replit CEO Amjad Masad 在 Figma Config 现场抛出一个激进判断:大语言模型正在把“软件开发”变成一种人人可参与的创作行为,而这不是未来,而是正在发生。

当所有人都在问“生成式 AI 会不会取代创作者”时,Ovetta Sampson 在 Figma Config 的舞台上给了一个反直觉答案:真正该紧张的不是人类,而是机器。她用70年的 AI 演进史、神经科学和一连串跨界故事,拆穿了这场被夸大的“创意末日论”。

当所有人都在问“AMD能不能打败英伟达”,真正让AI圈兴奋的却不是参数,而是一条不太起眼的合作线索。这条线,可能决定未来AI算力的玩法。

当谷歌、微软在开发者大会上疯狂堆叠AI叙事时,苹果在WWDC上选择了“只字不提AI”。没有大模型发布,没有生成式搜索,甚至连“人工智能”这个词都没出现。但正是这种反常识的克制,暴露了苹果一条更长线、也更危险的AI路线图。

如果你还觉得“AI取代工作”只是未来式,这组数据会直接打脸:美国企业上个月裁掉的8万人中,近5%明确与AI有关。与此同时,编剧、导演、研究员和创业公司,正在同一条时间线上感受到压力。这不是科幻,这是正在发生的行业重排。

如果我告诉你:AI已经能在你什么都不说的情况下,把你“看到的画面”复原成视频,你会觉得这是噱头还是失控的前夜?这项名为 Mind Video 的研究,正在把“读心术”从科幻拖进现实,而且速度比大多数人想象得更快。

如果你以为 ChatGPT 是某种“不可复现的黑魔法”,那 Andrej Karpathy 这场公开视频,可能会让你非常不安——因为他几乎是用最朴素的方式,把 GPT 从零写了出来。从字符级建模到 Transformer 内核,这不是科普,而是一次赤裸裸的技术摊牌。

在这期对谈里,Sahil Lavingia 抛出了一个让很多 AI 从业者不舒服的判断:未来不是 Builder 变多,而是变少。Transformer 已经简单到“有点震惊”,真正的稀缺正在从写代码转移到另一件事上。这不是鸡汤,而是一次冷静、现实、甚至有点残酷的行业复盘。

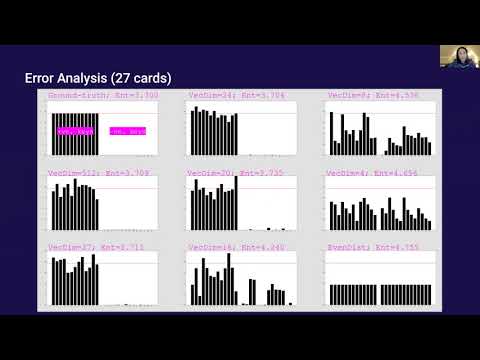

CLIP这类对比学习模型,被认为是多模态时代的基石。但在一个看似“玩具”的SET纸牌游戏里,它却暴露出一个致命短板:当关系、属性和实体一多,向量维度不够,模型会系统性失明。这不是调参问题,而是容量上限。