她把GPT-2“拆开看大脑”:一场关于语法藏在哪里的大胆实验

很多人以为,大语言模型只是靠“统计词频”在蒙答案。但在这场OpenAI Scholars Demo Day的演讲里,一位刚入行5个月的研究者,直接把GPT-2拆开,追问一个刺痛行业的问题:语法,究竟藏在模型的哪一层?答案,比你想象得更反直觉。

很多人以为,大语言模型只是靠“统计词频”在蒙答案。但在这场OpenAI Scholars Demo Day的演讲里,一位刚入行5个月的研究者,直接把GPT-2拆开,追问一个刺痛行业的问题:语法,究竟藏在模型的哪一层?答案,比你想象得更反直觉。

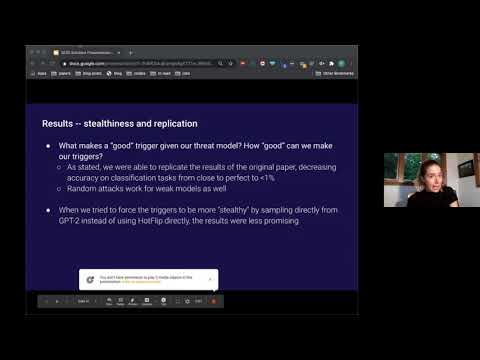

你以为只有图片模型才会被“对抗样本”骗?这场 OpenAI Scholars Demo Day 的演讲给了 NLP 社区当头一棒:只要在输入里悄悄塞进一句看似无关、甚至毫无意义的文本,就可能稳定地把语言模型带偏,而且还能跨模型迁移。

在 OpenAI Scholars Demo Day 上,Christine Payne 做了一件反直觉的事:她没有发明全新的音乐模型,而是把“生成音乐”硬生生改造成一个语言模型问题。结果令人震惊——很多人已经分不清 AI 和人类作曲。但真正的挑战,才刚刚开始。

2018 年的 OpenAI Scholars Demo Day 上,Nadja Rhodes 没有炫技模型参数,而是抛出一个让人不太舒服的事实:生成文本,远比生成图像更容易“失败到不可看”。她的项目 Deephypebot,不只是一个音乐评论机器人,而是一场关于“如何让语言模型不再胡说八道”的实验。

这是一场罕见的、偏向思想源头的对话。Ilya Sutskever回顾了深度学习崛起的关键节点,解释他为何信任经验主义与损失函数,并坦诚讨论大模型、通用人工智能与意识等终极问题。读完本文,你将理解今天AI路线背后的核心直觉。

这场炉边对话回顾了自然语言处理在2018年前后的关键转折,解释了为什么语言模型会成为AI的基础设施,并通过零样本学习与文本生成的真实实验,揭示“规模”如何意外地改变模型能力边界。

这场来自LinkedIn AI的分享,讲述了他们如何用一个大语言模型统一推荐、排序与个性化任务,并一步步把它真正部署到线上。它不仅回答了“LLM能不能做推荐”,更详细拆解了在延迟、成本和效果之间反复拉扯的工程现实。

在这场技术分享中,Netflix推荐系统负责人讲述了一次关键转向:放弃碎片化的推荐模型体系,转而用一个基础模型统一承载所有推荐需求。文章还原了这一决策的背景、技术细节与现实约束,解释为什么这不是一次简单的“模型升级”,而是一场组织与工程方式的重构。

这场来自 Instacart 搜索与机器学习团队的分享,讲述了他们如何在真实、高复杂度的杂货电商场景中引入大语言模型,解决传统搜索在冷启动、长尾查询和商品发现上的结构性难题,并在工程约束下找到可落地的平衡点。

这场演讲讲述了YouTube团队如何尝试让Gemini真正理解YouTube世界,并将大语言模型用于视频推荐与检索。核心不在于炫技,而是在规模、约束和产品现实下,重新思考LLM能做什么、不能做什么。