生成式AI的真实潜力:从模型到Agent的谨慎跃迁

这篇文章提炼了Y Combinator关于生成式AI的一次关键对话,重点不在模型参数,而在如何正确理解能力边界、开发者策略以及AI Agent可能带来的下一次飞跃。读完你会更清楚:哪些期待是现实的,哪些地方必须“非常谨慎”。

这篇文章提炼了Y Combinator关于生成式AI的一次关键对话,重点不在模型参数,而在如何正确理解能力边界、开发者策略以及AI Agent可能带来的下一次飞跃。读完你会更清楚:哪些期待是现实的,哪些地方必须“非常谨慎”。

Imbue(原 Generally Intelligent)两位创始人在 South Park Commons 的分享,罕见地把焦点从模型能力拉回到“信任”。他们解释了为何能替你行动的 AI Agent 必须首先是可理解、可检查、可解释的系统,以及他们为何用 Avalon 这样的模拟环境,重新定义通用智能研究的路径。

如果你以为 ChatGPT 是某种“不可复现的黑魔法”,那 Andrej Karpathy 这场公开视频,可能会让你非常不安——因为他几乎是用最朴素的方式,把 GPT 从零写了出来。从字符级建模到 Transformer 内核,这不是科普,而是一次赤裸裸的技术摊牌。

你可能以为大语言模型的秘密藏在万亿参数里,但 Karpathy 用一小时告诉你:一切可以从“最笨”的字符统计开始。这段视频最狠的地方在于,它把语言模型从神坛拉回到白板,用一个个可数、可画、可验证的步骤,让你真正理解模型在“想什么”。

这不是一次普通的产品发布,而是 OpenAI 当众展示:一个模型如何在一年内,从“代码准确率 0%”,进化到能写服务器、接 API、做小游戏。更反直觉的是,Ilya 亲口承认:这一切的原理,其实简单到令人不安。

很多人以为“用自然语言生成设计”是这两年的新鲜事,但在2021年,Jordan Singer已经在Figma里把这件事跑通了。这场看似讲插件的分享,其实完整展示了:设计×代码×AI,是如何一步步把设计工具变成“可对话的创造机器”。

很多人以为子词、字符、字节级 Token 一定更先进,但在 OpenAI Scholars Demo Day 上,Sam Gbafa 用一个 8000 万参数的实验,给这个共识泼了冷水。结果不但反直觉,还直接影响你今天怎么选 tokenizer、怎么配上下文窗口。

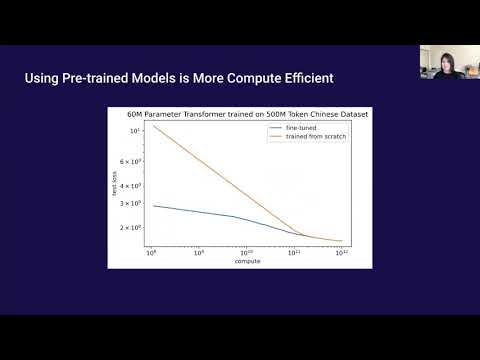

很多人直觉认为:只要模型够大、预训练够久,语言迁移自然水到渠成。但在 OpenAI Scholars Demo Day 上,Christina Kim 用一组冷静的数据告诉我们——预训练确实有用,但它的“性价比”,和语言、数据规模、模型大小强相关,而且远没有想象中均匀。

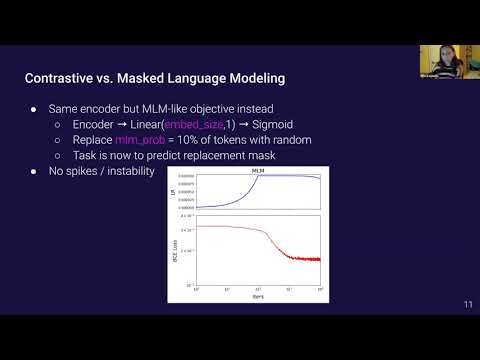

在计算机视觉里横扫榜单的对比学习,一搬到自然语言却问题频出。OpenAI Scholars Demo Day 上,Ellie Kitanidis 公开了一次并不“完美”的尝试:用对比学习预训练语言模型。真正的猛料不在结果,而在她暴露出的那个几乎所有语言模型都会撞上的隐形难题。

这是一场看似轻松的“编程梗图评审”,却意外暴露了George Hotz对编程、机器学习、测试工程和互联网产品的深刻理解。通过吐槽、段子和真实经历,他展示了一套极度工程师化、反直觉但高效的技术世界观。