英语模型迁移到中文有多难?OpenAI一组Scaling Laws给了残酷答案

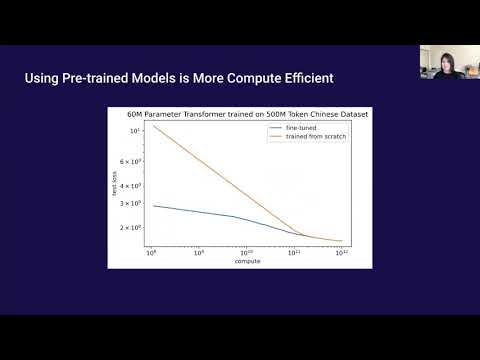

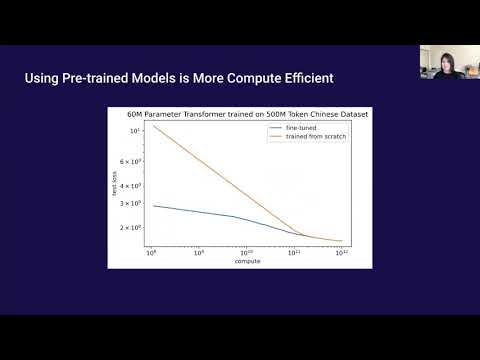

很多人直觉认为:只要模型够大、预训练够久,语言迁移自然水到渠成。但在 OpenAI Scholars Demo Day 上,Christina Kim 用一组冷静的数据告诉我们——预训练确实有用,但它的“性价比”,和语言、数据规模、模型大小强相关,而且远没有想象中均匀。

很多人直觉认为:只要模型够大、预训练够久,语言迁移自然水到渠成。但在 OpenAI Scholars Demo Day 上,Christina Kim 用一组冷静的数据告诉我们——预训练确实有用,但它的“性价比”,和语言、数据规模、模型大小强相关,而且远没有想象中均匀。

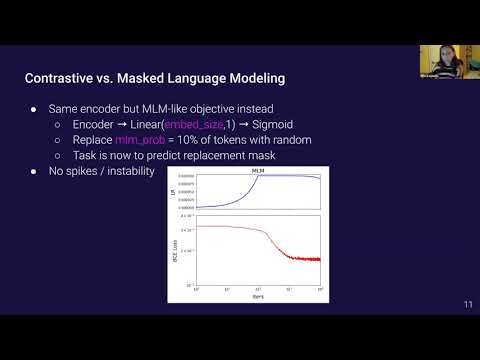

在计算机视觉里横扫榜单的对比学习,一搬到自然语言却问题频出。OpenAI Scholars Demo Day 上,Ellie Kitanidis 公开了一次并不“完美”的尝试:用对比学习预训练语言模型。真正的猛料不在结果,而在她暴露出的那个几乎所有语言模型都会撞上的隐形难题。

2020年,DeepMind发布AlphaFold 2,被认为解决了困扰生物学50年的蛋白质折叠难题。Lex Fridman在视频中不仅解释了技术突破本身,更从AI与生命科学交汇的角度,讨论了它为何可能成为一个“诺贝尔奖级别”的起点。

在这期 Lex Fridman 播客中,Keras 作者 François Chollet 直面一个尖锐问题:今天的深度学习模型,究竟是在“理解”,还是在“记忆”?他从语言、视觉、数据规模与泛化能力出发,系统阐述了自己对智能本质的定义,以及为何 ARC 基准测试被设计成反主流的存在。

Lex Fridman 通过 TensorFlow Playground 的可视化实验,展示了神经网络在不同结构与超参数下,如何逐步学会(或学不会)复杂数据分布。短短几分钟的视频,揭示了模型容量、特征工程与直觉理解之间的深刻联系。

很多人以为,大语言模型只是靠“统计词频”在蒙答案。但在这场OpenAI Scholars Demo Day的演讲里,一位刚入行5个月的研究者,直接把GPT-2拆开,追问一个刺痛行业的问题:语法,究竟藏在模型的哪一层?答案,比你想象得更反直觉。

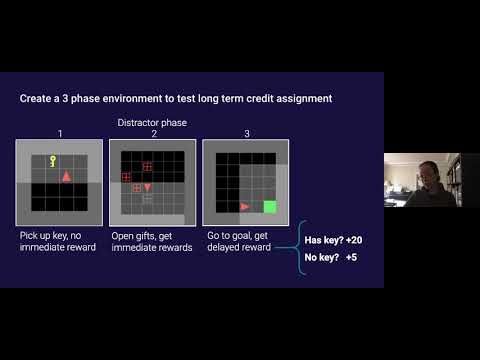

强化学习最怕什么?不是算力不够,也不是模型不深,而是奖励来得太晚。Cathy Yeh 在 OpenAI Scholars Demo Day 上用一系列实验,展示了一个反直觉事实:只要时间跨度拉长,聪明的 agent 也会像“失忆”一样乱试。这场分享的核心,是她如何用 Temporal Reward Transport(TRT)正面解决这个老大难问题。

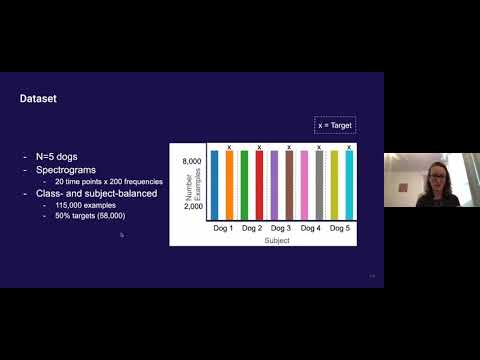

直到20年前,医学界还在争论一件事:癫痫发作到底能不能被预测?在 OpenAI Scholars Demo Day 上,一位神经科学出身的研究者用深度学习给出了一个并不完美、却足够震撼的答案——不仅能,而且很可能正是神经网络最擅长的那类问题。

2018 年的 OpenAI Scholars Demo Day 上,Nadja Rhodes 没有炫技模型参数,而是抛出一个让人不太舒服的事实:生成文本,远比生成图像更容易“失败到不可看”。她的项目 Deephypebot,不只是一个音乐评论机器人,而是一场关于“如何让语言模型不再胡说八道”的实验。

大多数AI绘画在学“风格”,但Holly Grimm反其道而行:她把人类艺术课上的构图原则,直接塞进了CycleGAN的训练目标里。结果不是更像某位大师,而是第一次让模型“听懂”什么叫色彩和谐、纹理变化与构图控制。