GPT-4还没看懂,下一代AI已经来了:三条线索指向ChatGPT之后的世界

如果你以为ChatGPT已经是AI的终局,那你可能低估了这一波技术浪潮的速度。就在多数人沉迷Prompt技巧时,OpenAI、Anthropic 和 Meta 已经同时向前迈了一步:搞懂模型、约束模型、以及——超越语言模型本身。

如果你以为ChatGPT已经是AI的终局,那你可能低估了这一波技术浪潮的速度。就在多数人沉迷Prompt技巧时,OpenAI、Anthropic 和 Meta 已经同时向前迈了一步:搞懂模型、约束模型、以及——超越语言模型本身。

AI 能把你“想的内容”变成文字了,而且不是关键词匹配,而是理解语义后的复述。这项登上《Nature Neuroscience》的研究,让无数人第一次认真思考:大模型和人脑,可能比我们想象的更像。

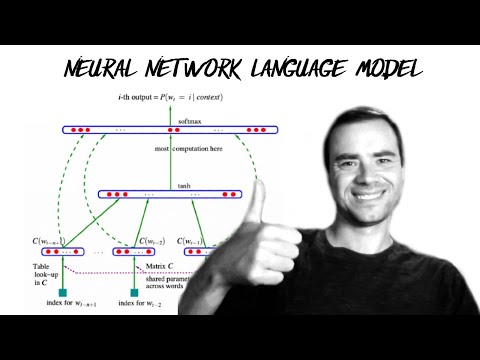

Karpathy 在 makemore 第二讲里,亲手演示了一个残酷事实:你以为还能靠统计和技巧硬撑的模型,会在规模一上来时彻底崩溃。而真正的转折点,不是调参,而是那一刻你被迫引入神经网络。

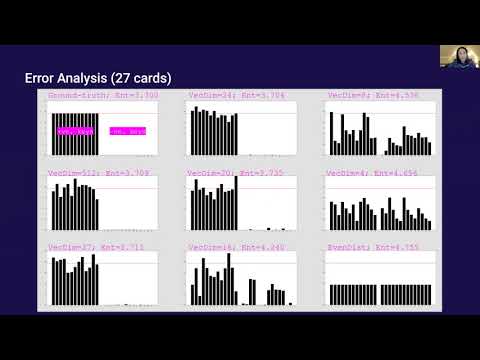

CLIP这类对比学习模型,被认为是多模态时代的基石。但在一个看似“玩具”的SET纸牌游戏里,它却暴露出一个致命短板:当关系、属性和实体一多,向量维度不够,模型会系统性失明。这不是调参问题,而是容量上限。

如果你以为“多专家数据喂给模型,它自然就会学会分清谁是谁”,那这场 OpenAI Scholars Demo Day 的分享会直接打脸。Tyna Eloundou 用一个看似优雅、实则极具野心的框架,展示了:我们不仅能让模型学到多种行为,还能在需要时精准切换它们。

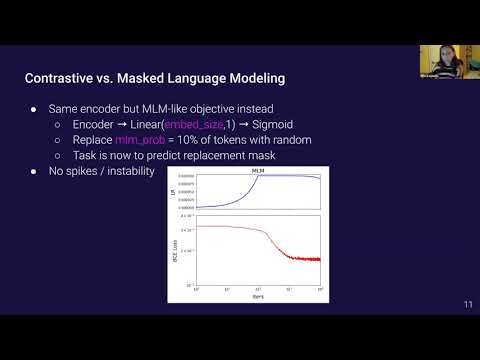

在计算机视觉里横扫榜单的对比学习,一搬到自然语言却问题频出。OpenAI Scholars Demo Day 上,Ellie Kitanidis 公开了一次并不“完美”的尝试:用对比学习预训练语言模型。真正的猛料不在结果,而在她暴露出的那个几乎所有语言模型都会撞上的隐形难题。

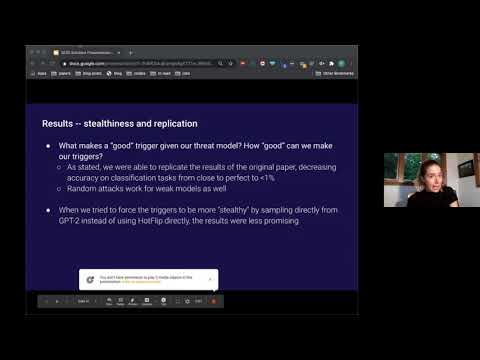

你以为只有图片模型才会被“对抗样本”骗?这场 OpenAI Scholars Demo Day 的演讲给了 NLP 社区当头一棒:只要在输入里悄悄塞进一句看似无关、甚至毫无意义的文本,就可能稳定地把语言模型带偏,而且还能跨模型迁移。

在这段对话中,Spotify高管Gustav Söderström讲述了一个少被外界理解的事实:真正让Spotify的推荐系统变强的,不只是算法,而是用户无意中创造的三十亿份歌单。它们像一门“音乐编程语言”,把人类的情感、语境和审美,转译成机器可以学习的结构化数据。

MIT教授Regina Barzilay在这期Lex Fridman播客中,讲述了她如何将深度学习引入癌症诊断与治疗,并分享了自己罹患乳腺癌后的视角转变。这不仅是一场关于机器学习的技术对话,更是一段关于科学、数据与人类生命复杂性的真实故事。

这是一场来自 South Park Commons 的技术分享,Jonathan Hseu 系统讲述了神经网络规模化背后的真实挑战:为什么规模如此重要、工程基础设施如何支撑,以及在模型设计和训练阶段必须做出的关键取舍。文章还原了一线实践中的方法论,而不只是抽象结论。