Karpathy亲手写反向传播:为什么顶级研究员还在“原始手搓”梯度

当所有框架都能自动求导时,Andrej Karpathy却花一整节课,带你一行行手写反向传播。这不是怀旧,而是一种训练直觉的残酷方式。看完这期视频,你会明白:真正拉开模型训练差距的,不是更大的GPU,而是你对梯度流动的掌控力。

当所有框架都能自动求导时,Andrej Karpathy却花一整节课,带你一行行手写反向传播。这不是怀旧,而是一种训练直觉的残酷方式。看完这期视频,你会明白:真正拉开模型训练差距的,不是更大的GPU,而是你对梯度流动的掌控力。

很多人以为神经网络训练不好,是架构不行、数据不够、算力太小。但 Karpathy 在 makemore 第三讲直接揭穿了一个更残酷的事实:大多数失败,发生在训练开始的第一秒——初始化、激活值和梯度,早就把结局写好了。

Karpathy 在 makemore 第二讲里,亲手演示了一个残酷事实:你以为还能靠统计和技巧硬撑的模型,会在规模一上来时彻底崩溃。而真正的转折点,不是调参,而是那一刻你被迫引入神经网络。

大多数人用 PyTorch 写神经网络,却从没真正“看见”梯度是怎么流动的。Andrej Karpathy 用一个叫 micrograd 的极简项目,亲手拆开了反向传播的黑箱:没有魔法、没有框架,只有链式法则。这支视频讲的不是“怎么用”,而是“为什么一切真的如此运作”。

设计系统最大的敌人不是规范不够,而是人类自己。一次 Config 演讲里,一位产品设计师展示了一个反直觉的原型:用 TensorFlow 给 Figma 做“拼写检查”,自动揪出设计系统里的隐形错误。这不是概念,而是已经跑起来的插件。

Lex Fridman 在解读 Tesla AI Day 时认为,这场发布会的震撼不在于单点技术突破,而在于首次完整展示了解决自动驾驶与通用机器人问题所需的“规模化工程全景”。从向量空间感知、多摄像头时序融合,到数据标注闭环与 Dojo 计算平台,Tesla 展示了一条难以复制的真实世界智能路线。

这不是一次普通的产品发布,而是 OpenAI 当众展示:一个模型如何在一年内,从“代码准确率 0%”,进化到能写服务器、接 API、做小游戏。更反直觉的是,Ilya 亲口承认:这一切的原理,其实简单到令人不安。

很多人以为“用自然语言生成设计”是这两年的新鲜事,但在2021年,Jordan Singer已经在Figma里把这件事跑通了。这场看似讲插件的分享,其实完整展示了:设计×代码×AI,是如何一步步把设计工具变成“可对话的创造机器”。

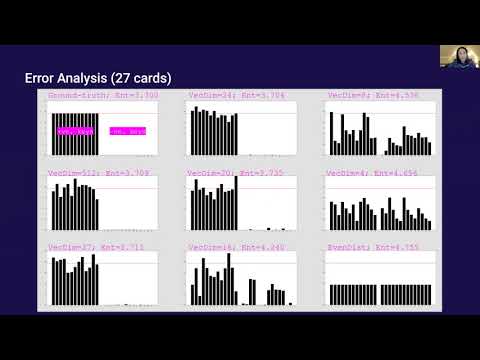

CLIP这类对比学习模型,被认为是多模态时代的基石。但在一个看似“玩具”的SET纸牌游戏里,它却暴露出一个致命短板:当关系、属性和实体一多,向量维度不够,模型会系统性失明。这不是调参问题,而是容量上限。

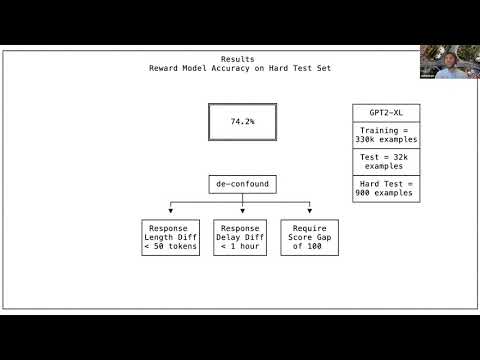

OpenAI 学者 Jonathan Ward 做了一件反直觉的事:不用人工标注、不请外包标注员,而是直接拿互联网的“点赞”来训练奖励模型。结果很震撼——模型学会了人类偏好,但准确率卡在了 74%。这背后,藏着今天所有 RLHF 系统的真相与瓶颈。