OpenAI被骂“虚伪游说”欧盟监管,这场舆论风暴到底谁在失真

一篇来自《时代》杂志的“独家调查”,把 OpenAI 推上了风口浪尖:嘴上高呼 AI 强监管,背地却在游说欧盟“放水”。听起来像铁证如山,但如果你真看过原始文件,会发现这场愤怒,可能正在伤害真正的 AI 安全。

一篇来自《时代》杂志的“独家调查”,把 OpenAI 推上了风口浪尖:嘴上高呼 AI 强监管,背地却在游说欧盟“放水”。听起来像铁证如山,但如果你真看过原始文件,会发现这场愤怒,可能正在伤害真正的 AI 安全。

如果你以为大众还在“害怕AI”,那这组数据会让你后背发凉:73%的消费者信任AI生成的内容,甚至愿意让AI给理财和医疗建议。这不是未来推演,而是已经发生的现实。

这是一场关于“如何把前沿技术真正交付给国防体系”的坦诚对话。Epirus联合创始人Bo Marr结合自己从顶级芯片研发到国防创业的经历,讲述了国防科技在技术路线、组织机制和商业模式上的独特挑战,以及为何“双重用途”与产品愿景决定了一家公司能走多远。

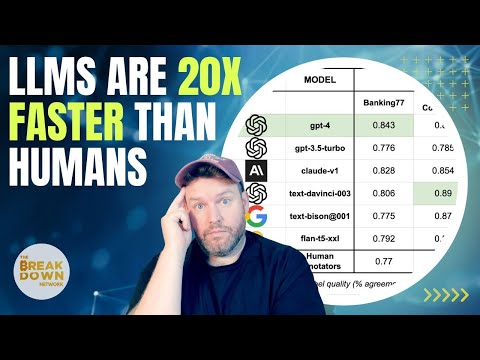

一项新研究给出了一个残酷但清晰的数字:大语言模型在数据标注上,比人类快20倍、便宜7倍,而且还更准。这不是单点突破,而是一连串信号——从程序员到音乐人,从欧盟立法者到广告公司,所有人都在同一周感受到了AI的“真实冲击波”。

只用一句自然语言提示,就能生成一个“能跑起来”的完整代码库——GPT Engineer在GitHub三天狂揽上万Star。这不是又一个AI玩具,而是把“自动化写代码”和“自主AI Agent”两股浪潮真正拧到了一起。

当 Marc Andreessen 高调宣称“AI 将拯救世界”时,硅谷几乎集体鼓掌。但在 The AI Daily Brief 解读的一篇博客中,Dwarkesh 做了一件少见的事:逐条拆解这篇乐观宣言,指出真正让人不安的,不是 AI 不够强,而是我们可能根本控制不了它。

很多人还在纠结“AutoGPT是不是噱头”,但一周内的前沿研究已经给出了更激进的答案:AI不只会自己规划和执行任务,还开始理解图像、重绘视频、克隆声音,甚至当老师去教另一个AI。这期《The AI Daily Brief》,几乎把2023年下半年的AI主线一次性摊开。

当所有人都在问“AI会不会毁灭人类”,这支视频却抛出一个更激进的判断:AI可能是人类文明有史以来最好的发明。更反直觉的是,真正的风险并不在技术本身,而在我们如何使用、限制甚至恐惧它。

大多数AI产品失败,不是模型不够强,而是用户根本“读不懂”。这场来自 Figma Config 的分享抛出一个反直觉观点:UX Writing 的真正杠杆,不是文案灵感,而是内容设计系统。它正在成为AI产品体验分水岭。

不是科幻小说,也不是推特玩笑。耶鲁一场CEO闭门调查显示,42%的顶级公司掌门人认为AI可能在5到10年内终结人类。但这条爆炸性数据背后,真正值得AI从业者警惕的,并不是“灭绝论”本身。