从Transformer到生物软件:Jakob Uszkoreit谈AI下一跳

Transformer共同作者Jakob Uszkoreit在播客中回顾了AI架构的关键转折,并解释他为何离开Google创办Inceptive,试图把深度学习的方法论引入RNA药物研发,重新思考“软件”与“生命”的边界。

Transformer共同作者Jakob Uszkoreit在播客中回顾了AI架构的关键转折,并解释他为何离开Google创办Inceptive,试图把深度学习的方法论引入RNA药物研发,重新思考“软件”与“生命”的边界。

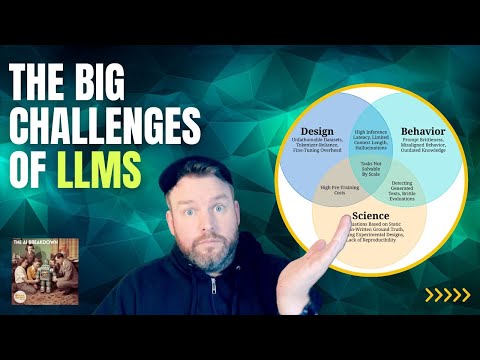

很多人第一次用 ChatGPT 时都有一种错觉:语言智能的问题,好像已经被解决了。但一篇由剑桥、UCL、Meta AI 等机构联合完成的论文却泼了一盆冷水——我们可能才刚刚站在起点。真正的挑战,不是“模型不够大”,而是一整套尚未被驯服的复杂系统问题。

ChatGPT 最近加了一个看似不起眼的功能,却悄悄改变了它的使用方式。它不是插件,不是代码解释器,而是一个“永久生效”的提示层。已经有人用它造助理、改人格,甚至逼近 AutoGPT。这一次,真正拉开差距的不是模型能力,而是你会不会用。

如果我告诉你:AI已经能在你什么都不说的情况下,把你“看到的画面”复原成视频,你会觉得这是噱头还是失控的前夜?这项名为 Mind Video 的研究,正在把“读心术”从科幻拖进现实,而且速度比大多数人想象得更快。

过去一年,AI 画图最大的笑话不是手画不好,而是字写不对。现在,这个“行业通病”第一次被正面击穿。Stability AI 体系下的开源模型 DeepFloyd IF,开始在图片里稳定生成可读文字——这件事的意义,远不只是“能写对单词”这么简单。

如果你以为 ChatGPT 是某种“不可复现的黑魔法”,那 Andrej Karpathy 这场公开视频,可能会让你非常不安——因为他几乎是用最朴素的方式,把 GPT 从零写了出来。从字符级建模到 Transformer 内核,这不是科普,而是一次赤裸裸的技术摊牌。

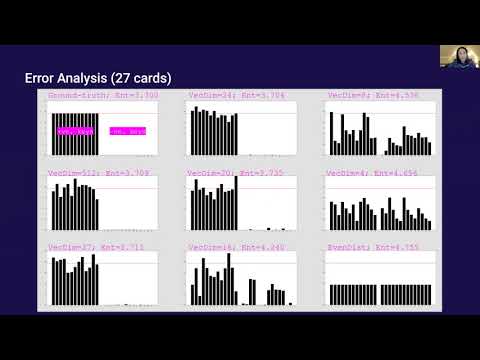

CLIP这类对比学习模型,被认为是多模态时代的基石。但在一个看似“玩具”的SET纸牌游戏里,它却暴露出一个致命短板:当关系、属性和实体一多,向量维度不够,模型会系统性失明。这不是调参问题,而是容量上限。

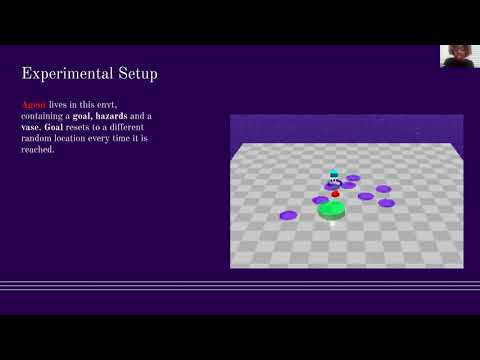

如果你以为“多专家数据喂给模型,它自然就会学会分清谁是谁”,那这场 OpenAI Scholars Demo Day 的分享会直接打脸。Tyna Eloundou 用一个看似优雅、实则极具野心的框架,展示了:我们不仅能让模型学到多种行为,还能在需要时精准切换它们。

很多人以为,大语言模型只是靠“统计词频”在蒙答案。但在这场OpenAI Scholars Demo Day的演讲里,一位刚入行5个月的研究者,直接把GPT-2拆开,追问一个刺痛行业的问题:语法,究竟藏在模型的哪一层?答案,比你想象得更反直觉。

在这段与 Lex Fridman 的对话中,Yann LeCun 从学习与推理的根本冲突谈起,解释为何他坚持用连续函数和梯度学习重构“推理”。他借助人脑记忆结构、能量最小化与世界模型,描绘了一条不同于符号主义AI的长期路线。