为什么Agent的大脑需要一本“作战手册”:从本体论到Graph RAG的实战收益

Neo4j 的 Jesús Barrasa 在这场分享中提出了一个反直觉但极具实践价值的观点:要让 AI Agent 更可靠,关键不只是更大的模型,而是一套清晰的“知识作战手册”——本体论。通过将本体论引入 Graph RAG,他展示了如何在构建和检索两个阶段显著提升 AI 应用的质量与可控性。

Neo4j 的 Jesús Barrasa 在这场分享中提出了一个反直觉但极具实践价值的观点:要让 AI Agent 更可靠,关键不只是更大的模型,而是一套清晰的“知识作战手册”——本体论。通过将本体论引入 Graph RAG,他展示了如何在构建和检索两个阶段显著提升 AI 应用的质量与可控性。

Elastic 工程师 Philipp Krenn 用一场充满自嘲与黑色幽默的演讲,揭开了向量搜索基准测试(benchmark)光鲜数据背后的真相:从“基准营销”到隐性作弊,再到为什么你最终只能相信自己的测试。

Jerry Liu在这场演讲中直言不讳地指出:当前大量AI Agent并没有真正自动化知识工作。他结合LlamaIndex的实践经验,系统拆解了知识型Agent的真实难点——非结构化数据、工具调用和端到端行动,并给出了一套更务实的构建方法论。

这是一次来自一线AI工程师的真实复盘:经历37次失败后,Jonathan Fernandes 总结出一套可在生产环境稳定运行的RAG技术栈。文章不仅讲清楚每一层该怎么选,更重要的是解释了为什么很多RAG项目会悄无声息地失败。

来自 14.ai 联合创始人兼 CTO Michael Fester 的真实经验,系统讲述如何用 TypeScript 的 Effect 库,在充满不确定性的 LLM 场景中构建可预测、可观测、可扩展的 AI 客服代理系统。

这篇文章还原了Travis Frisinger关于“连贯性陷阱”的核心观点:大语言模型之所以让人感觉聪明,并非因为它们在思考,而是因为它们在高维空间中制造了强烈的连贯感。通过个人实验、工具构建和理论反思,演讲者给出了一个极具启发性的设计方向:停止追逐智能,转而设计结构化共振。

这场演讲分享了Cato在构建云架构AI Copilot过程中的真实探索:为什么传统自动化不够用,以及如何通过多智能体、图结构和严谨评估,让AI参与复杂的架构推理与决策。

Ahmad Awais用一次现场“vibe coding”演示,讲清了一个反直觉结论:真正跑在生产环境里的AI Agent,几乎都不是用框架搭出来的,而是直接基于AI原语。本文还原他的技术判断、个人经历,以及一套可复用的Agent构建方法论。

OpenAI发布全新的Agents SDK与Responses API,试图把“构建AI代理”这件事从高门槛工程,变成开发者的日常能力。这不仅是一次产品更新,更是一次平台级博弈的公开宣战,直接改变了创业公司、开发者和竞争对手的游戏规则。

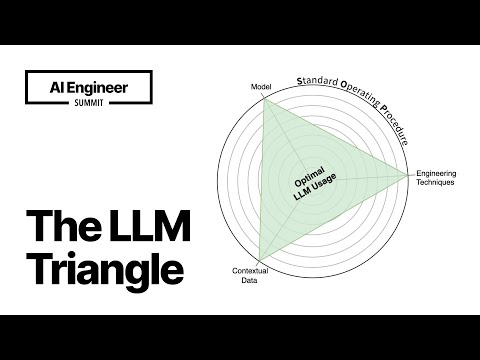

这场演讲并不是在教你“怎么调Prompt”,而是试图回答一个更难的问题:为什么90%的LLM应用死在生产环境。Almog Baku用工程师和创业者的视角,提出了“LLM三角”方法论——模型、工程技术、数据,在SOP的约束下协同工作,才可能构建稳定、可复现的AI应用。