一周AI新闻密到离谱:从文本造3D世界到Agent上岗,范式正在换挡

如果你觉得AI的进化是“渐进式”的,那这一周的新闻会直接打脸。从OpenAI把文字变成3D物体,到Hugging Face让模型开始“自己干活”,再到上下文窗口、视觉语言模型的集体跃迁,AI不只是更聪明了,而是正在换一种存在方式。

如果你觉得AI的进化是“渐进式”的,那这一周的新闻会直接打脸。从OpenAI把文字变成3D物体,到Hugging Face让模型开始“自己干活”,再到上下文窗口、视觉语言模型的集体跃迁,AI不只是更聪明了,而是正在换一种存在方式。

一封来自Google内部的泄密备忘录,直言“我们没有护城河,OpenAI也没有”。更残酷的是:击败巨头的不是另一家大公司,而是一群拿着开源模型、几百美元预算的开发者。这不是情绪宣泄,而是一份冷静到刺骨的行业判决书。

很多人以为 GPT‑4 已经够强了,但一位 AI 开发者在推特上说:真正的飞跃还没开始。当 GPT‑4‑32k 开放后,变化之大,将超过 GPT‑3.5 到 GPT‑4 的那一步。这不是模型参数的小改动,而是 AI“能做什么”边界的整体迁移。

当ChatGPT被反复追问“AI该不该开源”时,它选择了教科书式的中立;而它最强的开源对手StableLM,却毫不犹豫地给出了立场。这不是一次简单的模型对比,而是一次关于权力、商业与未来AI走向的正面碰撞。

当所有人都以为算力、数据和资本只会把AI推向更封闭的巨头游戏时,一波开源模型却开始“逆袭”。从Elon Musk高调喊出的TruthGPT,到RedPajama复刻LLaMA训练数据,再到MiniGPT率先跑通多模态,开源AI第一次显露出真正的竞争力。

大多数人以为 ChatGPT 能“记住一切”,但 McKay Wrigley 用一支实战视频证明:真正让 AI 懂你资料的,不是模型参数,而是你如何切文本、算向量、做搜索。这不是炫技教程,而是一套已经被无数产品验证过的底层方法。

当市场下跌、情绪崩盘,大多数人只想逃离。但在这期对谈里,讨论却反其道而行:从Web3的“未被设计过的世界”,到对Twitter未来的大胆想象,再到一句反复出现的信号——builders build。这不是宏观喊话,而是给长期主义者的行动线索。

2022年,Meta经历了史上最惨烈的一天:单日市值蒸发2500亿美元,用户首次下滑,全世界都在唱衰。但在这期和“增长之神”Nikita Bier的对谈里,一个反直觉的判断浮出水面:真正卡住Meta的,可能不是TikTok,而是苹果;而真正被低估的,也正是今天的Meta。

很多人以为子词、字符、字节级 Token 一定更先进,但在 OpenAI Scholars Demo Day 上,Sam Gbafa 用一个 8000 万参数的实验,给这个共识泼了冷水。结果不但反直觉,还直接影响你今天怎么选 tokenizer、怎么配上下文窗口。

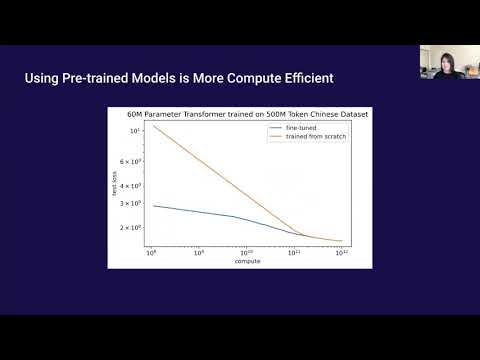

很多人直觉认为:只要模型够大、预训练够久,语言迁移自然水到渠成。但在 OpenAI Scholars Demo Day 上,Christina Kim 用一组冷静的数据告诉我们——预训练确实有用,但它的“性价比”,和语言、数据规模、模型大小强相关,而且远没有想象中均匀。