Karpathy想给AI改名:这不是文字游戏,而是行业转向信号

如果你还在争论“AI到底聪不聪明”,那你可能已经落后了一步。OpenAI前核心研究员Andrej Karpathy抛出一个看似温和、实则锋利的提议:别再叫AI了,叫“智能增强”。这不是语义洁癖,而是一场关于AI定位、风险和未来走向的关键转向。

如果你还在争论“AI到底聪不聪明”,那你可能已经落后了一步。OpenAI前核心研究员Andrej Karpathy抛出一个看似温和、实则锋利的提议:别再叫AI了,叫“智能增强”。这不是语义洁癖,而是一场关于AI定位、风险和未来走向的关键转向。

一场来自Y Combinator的圆桌讨论,把AGI的分歧摊在台面上:有人认为已然到来,有人坚持仍很遥远。比时间更重要的是定义、能力边界与伦理共识。

这不是一场关于模型参数的技术演讲,而是一次关于“人是什么”的实验。a16z与Generative Agents论文作者June Park,通过AI Town这一模拟世界,展示了大语言模型如何第一次被用来理解、而不只是模仿人类行为。

所有人都在等 OpenAI Dev Day 会不会发布 GPT-5,但真正值得警惕的信号,已经提前出现在 ChatGPT 里了。从“All Tools”到 32K 上下文,这不是功能更新,而是计算范式的转向。

大模型一定要跑在云端?Stability AI用一个“能在普通手机上跑”的3B参数模型,直接把这个共识掀翻。更刺激的是,这正在迫使苹果、OpenAI,甚至整个AI硬件形态重新思考自己的下一步。

一个开源模型,参数1800亿,训练算力是LLaMA 2的4倍,实测性能击败GPT-3.5——而这还只是开始。Falcon 180B的发布,不只是技术里程碑,更把“强大AI该不该开源”的争论推到了必须表态的临界点。

OpenAI 开放 GPT‑3.5 Turbo 微调,看起来只是一个功能更新,却意外点燃了企业 AI 的核心争议:数据该不该交给第三方?是继续烧钱自建模型,还是相信平台化微调?这可能比 GPT‑4 本身更具长期影响。

当92%的美国程序员已经在工作内外使用AI写代码,真正的竞争才刚开始。Stability AI突然丢出StableCode,号称专为编程而生、拥有16K上下文窗口的开源模型;与此同时,Google把“写代码”直接搬进浏览器云端。谁会成为下一代开发者的默认搭档?

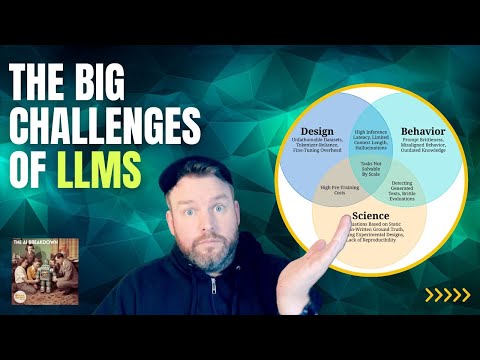

很多人第一次用 ChatGPT 时都有一种错觉:语言智能的问题,好像已经被解决了。但一篇由剑桥、UCL、Meta AI 等机构联合完成的论文却泼了一盆冷水——我们可能才刚刚站在起点。真正的挑战,不是“模型不够大”,而是一整套尚未被驯服的复杂系统问题。

当 Sam Altman 一边推动 ChatGPT 改变世界,一边让人们扫描虹膜领取代币,争议就不可避免了。Worldcoin 被包装成“AI 时代的解药”:既解决人类与 AI 的身份区分,又指向全民基本收入。但越往里看,它越像一场危险而重要的社会实验。