TensorFlow诞生记:一次从内部工具到全球标准的冒险

这是一段关于TensorFlow如何从Google内部的实验性工具,演变为全球机器学习基础设施的真实历史。Rajat Monga回顾了Google Brain早期的关键决策、开源背后的犹豫与勇气,以及TensorFlow 2.0为何必须“推倒重来”。

这是一段关于TensorFlow如何从Google内部的实验性工具,演变为全球机器学习基础设施的真实历史。Rajat Monga回顾了Google Brain早期的关键决策、开源背后的犹豫与勇气,以及TensorFlow 2.0为何必须“推倒重来”。

这是一场发生在MIT论文发布之后的对话。马斯克不仅解释了Autopilot最初为何“不是梦想”,还系统讲述了特斯拉在数据、AI芯片与软件路线上的关键选择,以及他与学界在“人是否该继续介入驾驶”这一问题上的根本分歧。

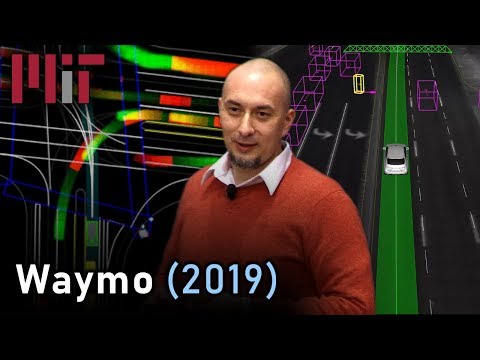

Waymo首席科学家Drago Anguelov在MIT的演讲,罕见系统性地讲清了自动驾驶为何难、难在哪,以及Waymo如何用感知、预测、规划与大规模仿真去“驯服长尾事件”。这不仅是一场技术报告,更是一套可落地的方法论。

在这期Lex Fridman播客中,计算神经科学家Tomaso Poggio回顾了自己从童年物理兴趣出发,到研究大脑与机器智能的学术旅程。他围绕视觉系统、神经网络与学习机制,提出了关于“智能为何如此困难”的深刻洞见。

Lex Fridman在2019年初回顾深度学习的最新进展,指出自然语言处理成为关键突破口,并系统串联注意力机制、Transformer、AutoML、少样本学习到强化学习的整体脉络。这是一份理解现代AI如何走向通用能力的路线图。

这是一堂关于深度学习的入门课,却远不止介绍模型和代码。Lex Fridman从数据、算力、社区与历史周期出发,解释为什么深度学习在今天爆发,又为什么它仍然充满局限。这篇文章提炼了演讲中最具洞见的观点、案例与警示。

2018年,OpenAI一次实习生分享里,悄悄点破了生成式模型最残酷也最重要的真相:会“想象”的模型,反而最容易被骗。这场关于世界模型、VAE、PixelCNN和可逆流的演讲,至今仍在影响AI Agent的设计路径。

当机器人能灵巧地转动物体,却因为摄像头轻微挪动就“失明”,问题不在控制,而在视觉。OpenAI 2018 年的一次实习分享,揭开了一个反直觉事实:再强的神经网络,也会被错误的视觉假设拖垮。

MIT自动驾驶技术研究并不从算法开始,而是从数据开始。这段视频完整展示了他们如何设计一套名为Rider的数据采集系统,在真实世界中、跨越数十万辆里程,稳定地记录人类驾驶行为。它揭示了一个常被忽视却决定成败的事实:深度学习的上限,往往由数据工程决定。

这是一堂来自MIT的深度学习课程实录,Lex Fridman围绕“人类感知”这一最难也最重要的AI问题,系统讲述了从数据、模型到硬件的真实挑战,以及为什么计算机视觉的核心不只是算法,而是对人的理解。