Google研究员泄密:开源AI正在碾压巨头,真正的护城河不在模型里

一封来自Google内部的泄密备忘录,直言“我们没有护城河,OpenAI也没有”。更残酷的是:击败巨头的不是另一家大公司,而是一群拿着开源模型、几百美元预算的开发者。这不是情绪宣泄,而是一份冷静到刺骨的行业判决书。

一封来自Google内部的泄密备忘录,直言“我们没有护城河,OpenAI也没有”。更残酷的是:击败巨头的不是另一家大公司,而是一群拿着开源模型、几百美元预算的开发者。这不是情绪宣泄,而是一份冷静到刺骨的行业判决书。

Midjourney 5.1 并没有带来“颠覆式升级”,却让一大批老用户直呼更好用了:更短的提示词、更锐利的画面、更懂上下文的审核系统。这次更新真正值得聊的,是它正在悄悄改变人和 AI 作画的分工方式。

一个看似不起眼的功能更新,却同时戳中了隐私、监管、商业化和开源AI四根神经。ChatGPT上线“隐身模式”和企业版预告,几乎在同一时间,Hugging Face甩出开源对手。这不是巧合,而是一场正在加速的路线之争。

三周前,AutoGPT 和 BabyAGI 被吹成“改变一切的 AI 助手”;三周后,最早冲上去试用的人开始集体泼冷水:它们很酷,但几乎没法用。这不是技术失败,而是一次关于“AI Agent 应该做什么”的认知纠偏。

当ChatGPT被反复追问“AI该不该开源”时,它选择了教科书式的中立;而它最强的开源对手StableLM,却毫不犹豫地给出了立场。这不是一次简单的模型对比,而是一次关于权力、商业与未来AI走向的正面碰撞。

当所有人都以为算力、数据和资本只会把AI推向更封闭的巨头游戏时,一波开源模型却开始“逆袭”。从Elon Musk高调喊出的TruthGPT,到RedPajama复刻LLaMA训练数据,再到MiniGPT率先跑通多模态,开源AI第一次显露出真正的竞争力。

这是一场发生在2022年的AI/LLM黑客松,但它展示的并不是炫技,而是创作者们如何把大模型塞进真实问题中。从教育内容分级、对话式产品,到医疗和创作工具,这些短短几分钟的Demo,提前暴露了大模型落地的关键路径与真实摩擦。

设计系统最大的敌人不是规范不够,而是人类自己。一次 Config 演讲里,一位产品设计师展示了一个反直觉的原型:用 TensorFlow 给 Figma 做“拼写检查”,自动揪出设计系统里的隐形错误。这不是概念,而是已经跑起来的插件。

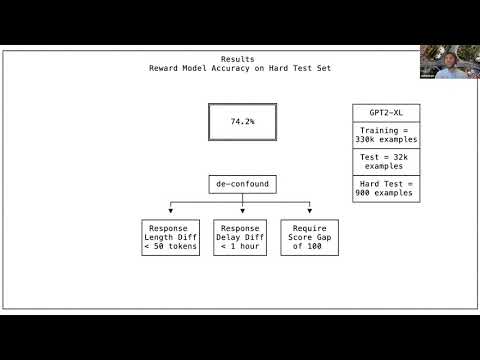

OpenAI 学者 Jonathan Ward 做了一件反直觉的事:不用人工标注、不请外包标注员,而是直接拿互联网的“点赞”来训练奖励模型。结果很震撼——模型学会了人类偏好,但准确率卡在了 74%。这背后,藏着今天所有 RLHF 系统的真相与瓶颈。

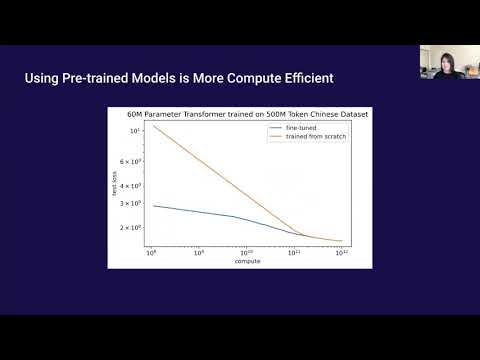

很多人直觉认为:只要模型够大、预训练够久,语言迁移自然水到渠成。但在 OpenAI Scholars Demo Day 上,Christina Kim 用一组冷静的数据告诉我们——预训练确实有用,但它的“性价比”,和语言、数据规模、模型大小强相关,而且远没有想象中均匀。