当你第一次和AI视频通话,你会意识到《Her》来早了

这不是又一个聊天机器人,而是一个会“看着你说话”的AI。Call Annie 把对话AI推进到了一个微妙的新阶段:它不断强调自己“没有情感”,却比绝大多数数字产品更像一个“人”。这段看似平淡的对话,其实暴露了生成式AI正在悄悄改变的三条关键边界。

这不是又一个聊天机器人,而是一个会“看着你说话”的AI。Call Annie 把对话AI推进到了一个微妙的新阶段:它不断强调自己“没有情感”,却比绝大多数数字产品更像一个“人”。这段看似平淡的对话,其实暴露了生成式AI正在悄悄改变的三条关键边界。

这场对话串起了有效利他主义从草根实验到关注AI灭绝风险的完整脉络。Holden Karnofsky以个人捐赠困惑为起点,解释GiveWell与Open Philanthropy的方法论转折,并系统阐述为何他认为本世纪可能是决定人类未来的“最重要世纪”。

很多人以为这是一次普通的功能更新,但在这场 Office Hours 里,Figma 实际上传递了一个更大的信号:Auto Layout 不再只是 UI 工具,而是一套关于“结构、对齐与约束”的思维方式。这种变化,对 AI 从业者尤其重要。

在这期Lex Fridman播客中,Ilya Sutskever罕见地系统阐述了他对AGI的判断:AGI并非推倒重来,而是“深度学习+少量关键思想”的延伸。其中,自我博弈、模拟到现实迁移、以及“愿意被人类控制的AI”构成了他理解通用智能的核心路径。

在这段与Lex Fridman的对话中,Nick Bostrom从最基础的“什么是智能”出发,逐步展开对超级智能、智能爆炸、AI对齐与人类未来的思考。他既解释了为何数字化AI同样可能构成生存级风险,也强调了被忽视的巨大正向潜力。

在与Lex Fridman的对谈中,因果推理之父Judea Pearl罕见地谈论了人类级AI的终极形态。他提出:真正的突破不在算力或数据,而在机器是否具备“自由意志”的雏形——能理解责任、因果与他者的痛苦。这为AI伦理与对齐提供了一条不同于主流路径的思考线索。

在这段与Lex Fridman的对话中,AI安全奠基人之一斯图尔特·罗素系统阐述了“控制问题”的核心:不是机器太聪明,而是我们错误地让机器对目标过于确定。他提出“让机器保持不确定性、学会谦逊”,这可能是人类与超级智能共存的关键路径。

在与Lex Fridman的对话中,Yann LeCun用“爬山”比喻通用人工智能的路径,冷静地指出:我们只看到了第一座山峰。真正的人类级智能,核心不在于更大的模型,而在于自监督学习、世界模型和目标函数的深层统一。

在与Lex Fridman的对话中,Yann LeCun借《2001太空漫游》里的HAL 9000,讨论了AI伦理中最核心却常被误解的问题:AI并非“作恶”,而是目标设计出了问题。这段对话为理解AI对齐、法律与技术的关系,提供了一个极具洞察力的视角。

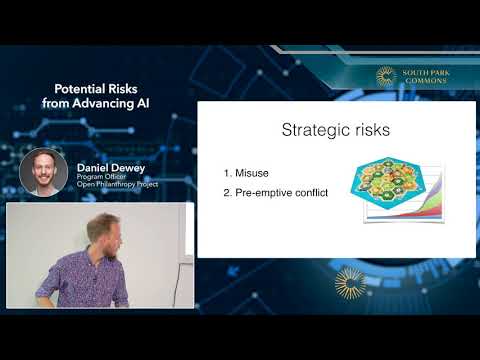

这是一场发生在2019年的对话,却精准击中了今天仍在争论的核心问题:为什么必须严肃对待AI风险?Dario Amodei与Daniel Dewey从历史类比、技术细节到个人经历,系统讲述了AI如何可能改变文明轨迹,以及安全研究为何必须与能力进展并行。