一张GPU引发的地缘震荡:AI如何变成大国博弈的新武器

当美国要求英伟达停止向中东出售A100和H100时,表面是芯片管制,实则是一场围绕AI主导权的全球博弈。这篇文章拆解AI如何从技术工具,迅速升级为地缘政治的核心变量,以及这对每一个AI从业者意味着什么。

当美国要求英伟达停止向中东出售A100和H100时,表面是芯片管制,实则是一场围绕AI主导权的全球博弈。这篇文章拆解AI如何从技术工具,迅速升级为地缘政治的核心变量,以及这对每一个AI从业者意味着什么。

如果你还觉得AGI只是远未来的科幻,那这组数据可能会让你后背一凉:在一个聚合了上千名预测者的市场里,AGI在2032年前出现的概率被推到了92%。这不是某个大佬的豪言,而是集体智能给出的冷静下注。

当所有人盯着大模型参数和算力军备竞赛时,亚马逊选择了一条更“务实”的路:从电商评论、云端芯片到生成式AI基础设施,三步看似平淡,却可能比炫技更致命。

一个原本在黑客论坛兜售的“犯罪AI”,突然开始加护栏、谈白帽;几天后,一个更赤裸裸的 Evil-GPT 立刻补位。这个故事揭示了一个让整个 AI 行业都无法回避的现实:你封住的不是风险,只是把它转移给下一个人。

当所有人都在问“AI会不会毁灭人类”,经济学家Tyler Cowen却给出一个更刺痛的判断:真正让我们恐慌的,不是AI本身,而是我们太久没活在真正的历史里。这期《AI Daily Brief》把AI风险,放进了一个大多数从业者忽略的历史坐标系。

如果你以为AI最大的风险还停留在“未来失控”,那你可能已经落后了。就在同一周,AI深度伪造逼近美国大选、资本与技术开始对中国“硬脱钩”,而模型竞赛却在悄悄加速。这不是三条新闻,而是一张正在收紧的时代之网。

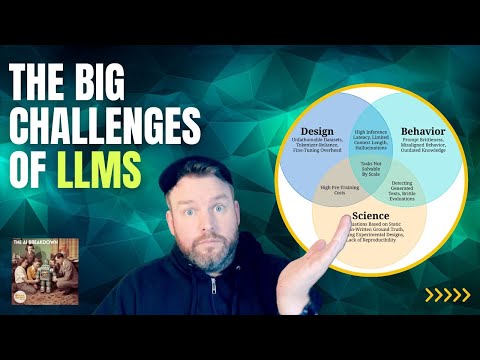

很多人第一次用 ChatGPT 时都有一种错觉:语言智能的问题,好像已经被解决了。但一篇由剑桥、UCL、Meta AI 等机构联合完成的论文却泼了一盆冷水——我们可能才刚刚站在起点。真正的挑战,不是“模型不够大”,而是一整套尚未被驯服的复杂系统问题。

7月的AI圈,第一次出现了“降温”的信号:ChatGPT用户下滑、监管与伦理突然加速、而真正的爆点却来自Meta的开源模型。表面是新闻回顾,背后却是一条清晰的行业分水岭——AI正在从狂热期,走向硬碰硬的落地期。

过去几个月,程序员、产品经理、研究员同时发出一个声音:ChatGPT变“笨”了。这不是情绪宣泄——斯坦福与伯克利的一篇论文给出了震撼数据,但随之而来的反驳同样致命。真相可能比“被降级”更复杂,也更值得每个AI从业者警惕。

ChatGPT不是被夸得太猛,而是第一次被美国政府“正式盯上”。FTC一封20页调查函,把OpenAI的训练数据、幻觉问题、企业客户、甚至公司治理全部摊开检查。这不是一次普通调查,而是AI监管真空期里最具信号意义的一枪。