一个设计师用 TensorFlow 做了件狠事:让设计系统有了“AI 拼写检查”

设计系统最大的敌人不是规范不够,而是人类自己。一次 Config 演讲里,一位产品设计师展示了一个反直觉的原型:用 TensorFlow 给 Figma 做“拼写检查”,自动揪出设计系统里的隐形错误。这不是概念,而是已经跑起来的插件。

设计系统最大的敌人不是规范不够,而是人类自己。一次 Config 演讲里,一位产品设计师展示了一个反直觉的原型:用 TensorFlow 给 Figma 做“拼写检查”,自动揪出设计系统里的隐形错误。这不是概念,而是已经跑起来的插件。

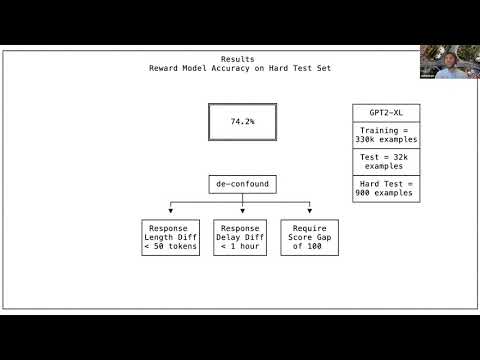

OpenAI 学者 Jonathan Ward 做了一件反直觉的事:不用人工标注、不请外包标注员,而是直接拿互联网的“点赞”来训练奖励模型。结果很震撼——模型学会了人类偏好,但准确率卡在了 74%。这背后,藏着今天所有 RLHF 系统的真相与瓶颈。

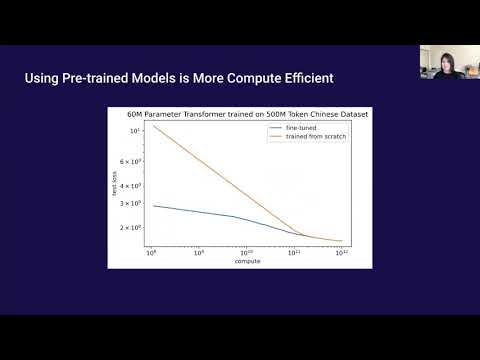

很多人直觉认为:只要模型够大、预训练够久,语言迁移自然水到渠成。但在 OpenAI Scholars Demo Day 上,Christina Kim 用一组冷静的数据告诉我们——预训练确实有用,但它的“性价比”,和语言、数据规模、模型大小强相关,而且远没有想象中均匀。

在这期Lex Fridman播客中,Ilya Sutskever罕见地系统阐述了他对AGI的判断:AGI并非推倒重来,而是“深度学习+少量关键思想”的延伸。其中,自我博弈、模拟到现实迁移、以及“愿意被人类控制的AI”构成了他理解通用智能的核心路径。

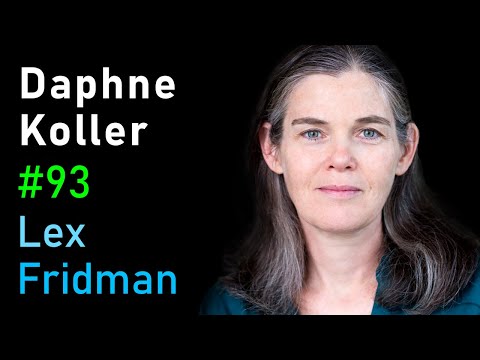

这是一场关于机器学习如何真正改变生物医学的深度对话。Daphne Koller结合学术、创业与教育三重经历,讨论了疾病机理、健康寿命、数据到洞见的转化,以及技术力量背后的价值判断。

在这段对话中,Alexa首席科学家Rohit Prasad直言:深度学习仍然强大,但无法独自解决“推理”这一终极难题。他结合Alexa的真实场景,解释了为什么下一代AI必须跨越预测,走向更接近人类目标理解的推理能力。

在与 Lex Fridman 的对话中,Gary Marcus 系统性地反思了深度学习的边界。他认为,当前 AI 最大的瓶颈不在算力或数据,而在缺乏“常识”和可解释的认知模型。本文提炼了他最关键的洞见、经典案例与争议观点。

在这段与Lex Fridman的对话中,fast.ai创始人Jeremy Howard给出了与主流路径截然不同的深度学习学习建议:不要停留在看论文或跑推理,而是亲手训练、微调大量模型,并且始终围绕你真正关心的真实问题。

2018年,OpenAI一次实习生分享里,悄悄点破了生成式模型最残酷也最重要的真相:会“想象”的模型,反而最容易被骗。这场关于世界模型、VAE、PixelCNN和可逆流的演讲,至今仍在影响AI Agent的设计路径。

这场2016年的演讲中,Andrej Karpathy系统回顾了计算机视觉从手工特征到深度学习的范式转移。他不仅解释了卷积神经网络为何有效,还通过历史转折、现场演示和方法论,总结了深度学习改变视觉领域的根本原因。