为什么真正可用的AI Agent,核心问题不是能力而是信任

Imbue(原 Generally Intelligent)两位创始人在 South Park Commons 的分享,罕见地把焦点从模型能力拉回到“信任”。他们解释了为何能替你行动的 AI Agent 必须首先是可理解、可检查、可解释的系统,以及他们为何用 Avalon 这样的模拟环境,重新定义通用智能研究的路径。

Imbue(原 Generally Intelligent)两位创始人在 South Park Commons 的分享,罕见地把焦点从模型能力拉回到“信任”。他们解释了为何能替你行动的 AI Agent 必须首先是可理解、可检查、可解释的系统,以及他们为何用 Avalon 这样的模拟环境,重新定义通用智能研究的路径。

在这期与Lex Fridman的长谈中,认知科学家Joscha Bach从“现实是否存在”“我们是否拥有自由意志”一路谈到AI代理与社会激励结构。他提出:自我、自由意志并非幻觉,而是有用的模型;理解这些模型,才能真正理解人类意识与未来的人工智能。

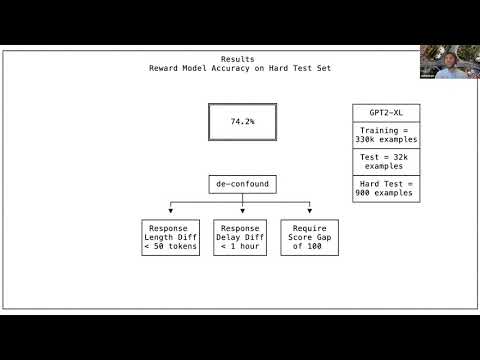

OpenAI 学者 Jonathan Ward 做了一件反直觉的事:不用人工标注、不请外包标注员,而是直接拿互联网的“点赞”来训练奖励模型。结果很震撼——模型学会了人类偏好,但准确率卡在了 74%。这背后,藏着今天所有 RLHF 系统的真相与瓶颈。

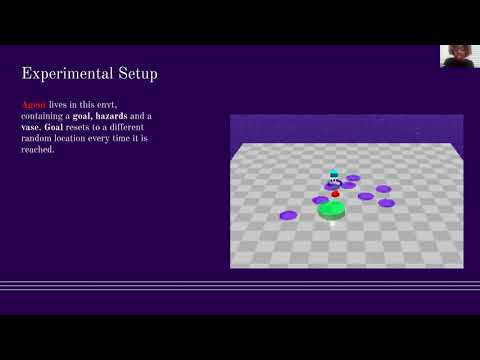

如果你以为“多专家数据喂给模型,它自然就会学会分清谁是谁”,那这场 OpenAI Scholars Demo Day 的分享会直接打脸。Tyna Eloundou 用一个看似优雅、实则极具野心的框架,展示了:我们不仅能让模型学到多种行为,还能在需要时精准切换它们。

在这期Lex Fridman播客中,Risto Miikkulainen用进化的视角重新审视人工智能。他不仅解释了什么是神经进化,更讨论了人类为何特殊、情感与死亡是否必要,以及“探索”如何成为构建下一代AI Agent的核心原则。

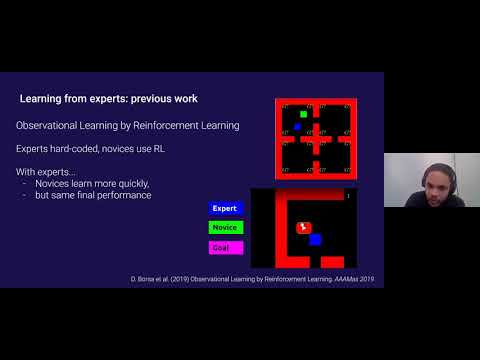

我们总以为,把多个 AI Agent 放在同一个环境里,它们自然会像人类一样“偷师学艺”。但在 OpenAI Scholars Demo Day 上,Kamal N’dousse 用一系列实验给出了一个极不讨喜、却极其重要的结论:大多数时候,智能体根本懒得学别人。

AGI这个如今被反复讨论的词,并非一次宏大的理论发明,而是一次略带妥协的命名选择。Ben Goertzel回顾了AGI一词的诞生过程,从一本书的标题争论,到DeepMind创始人、AIXI理论和对“智能”本身的怀疑,揭示了AGI背后被忽略的历史与思想张力。

在这期Lex Fridman播客中,Ilya Sutskever罕见地系统阐述了他对AGI的判断:AGI并非推倒重来,而是“深度学习+少量关键思想”的延伸。其中,自我博弈、模拟到现实迁移、以及“愿意被人类控制的AI”构成了他理解通用智能的核心路径。

这是一篇基于DeepMind研究员David Silver与Lex Fridman对话的深度文章,系统梳理了强化学习与深度强化学习的核心思想、方法分解,以及神经网络为何成为突破关键,同时保留了他对AI历史、未来与人类直觉局限的独特反思。

这期对话中,Marcus Hutter从“什么是智能”这一根本问题出发,串联起奥卡姆剃刀、所罗门诺夫归纳和AIXI模型,勾勒出一种极端但清晰的通用人工智能理论蓝图。文章提炼其中最有价值的思想,让你理解为何“压缩”可能是理解智能的核心钥匙。