开源正面硬刚 ChatGPT:能上网的 HuggingChat,正在逼近临界点

如果你还以为 ChatGPT 的优势不可撼动,这条消息会让你重新评估:开源阵营第一次在“关键能力”上追平闭源模型。能联网搜索的 HuggingChat、性能逼近闭源的 Falcon 40B,以及监管对 AI 内容标签的逼近,共同勾勒出一个正在急转弯的 AI 时代。

如果你还以为 ChatGPT 的优势不可撼动,这条消息会让你重新评估:开源阵营第一次在“关键能力”上追平闭源模型。能联网搜索的 HuggingChat、性能逼近闭源的 Falcon 40B,以及监管对 AI 内容标签的逼近,共同勾勒出一个正在急转弯的 AI 时代。

当所有人以为“大模型只会越来越大”,Intel却拿出1万亿参数押注科学研究;Meta用《圣经》训练出覆盖4000种语言的语音模型;而一篇论文却告诉行业:少量微调,反而赢过GPT‑4。这不是热闹,而是方向改变的信号。

Google研究员Karan Singhal回顾了自己从青少年时期的AI项目,到主导Med-PaLM 2医疗大模型的关键转折。这期对话不仅解释了为什么医疗AI不能“直接套用”通用大模型,也系统阐述了预训练、微调、评估与真实医疗工作流之间的张力。

插件不是给ChatGPT“加功能”,而是把它从聊天机器人推向“可执行系统”。从买菜、订机票,到金融研究、代码分析,这一波插件真正改变的,是AI与现实世界的连接方式。

IBM宣布“用AI替代7800个岗位”,但真相比裁员更冷酷;亚马逊不满足于Bedrock,直接重做Alexa的大模型;而UT Austin的研究,已经能把脑电活动翻译成文字。更耐人寻味的是,这一切背后,AI教父Hinton选择了离开。

在这期《No Priors》播客中,Sarah Guo 与 Elad Gil 罕见地放下准备稿,直接回答听众关于开源模型、AI Agent、监管与AGI的尖锐问题。他们从投资者和一线观察者视角,给出了多个清晰判断:开源大模型正在快速追赶闭源巨头,训练成本会持续下降,而真正决定格局的不是技术本身,而是谁能长期跑在前面并把领先优势变成商业结果。

如果你还以为 AI 生成视频只是“会动的图片”,那你已经落后一个时代了。就在一周之内,从 NVIDIA 的研究到 Runway Gen-2 的实测放出,文本生成视频这件事,突然从“实验室炫技”变成了“普通人也能上手的创作工具”。更重要的是,它正在改写内容创作、影视、游戏,甚至模拟世界的规则。

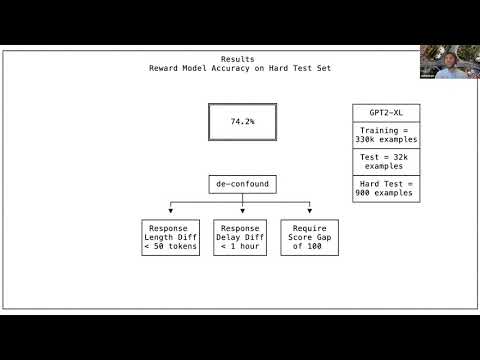

OpenAI 学者 Jonathan Ward 做了一件反直觉的事:不用人工标注、不请外包标注员,而是直接拿互联网的“点赞”来训练奖励模型。结果很震撼——模型学会了人类偏好,但准确率卡在了 74%。这背后,藏着今天所有 RLHF 系统的真相与瓶颈。

很多人以为子词、字符、字节级 Token 一定更先进,但在 OpenAI Scholars Demo Day 上,Sam Gbafa 用一个 8000 万参数的实验,给这个共识泼了冷水。结果不但反直觉,还直接影响你今天怎么选 tokenizer、怎么配上下文窗口。

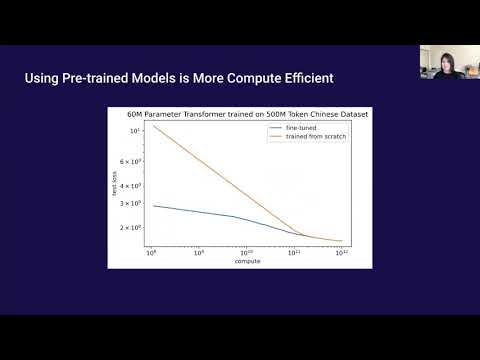

很多人直觉认为:只要模型够大、预训练够久,语言迁移自然水到渠成。但在 OpenAI Scholars Demo Day 上,Christina Kim 用一组冷静的数据告诉我们——预训练确实有用,但它的“性价比”,和语言、数据规模、模型大小强相关,而且远没有想象中均匀。