3亿新网民不是用电脑上网的:被忽视的设计战场

当你还在为深色模式和动效细节争论不休时,全球数十亿人第一次上网,却是在2G网络、60美元手机、不会读英文的环境下完成的。来自Figma Config的这场分享,揭开了一个被主流AI与产品圈长期忽视的真相:你以为的“好设计”,可能正在劝退下一代互联网用户。

当你还在为深色模式和动效细节争论不休时,全球数十亿人第一次上网,却是在2G网络、60美元手机、不会读英文的环境下完成的。来自Figma Config的这场分享,揭开了一个被主流AI与产品圈长期忽视的真相:你以为的“好设计”,可能正在劝退下一代互联网用户。

Lex Fridman 通过 Pixel 6 的一次“AI 开箱”,讲清了智能手机竞争正在从参数堆叠,转向以 AI 芯片为核心的体系之争。这不仅是一次硬件评测,更是一份关于边缘 AI、异构计算与未来人机关系的思考。

这期对话中,Dan Kokotov从工程与人的双重视角,讲述了语音识别技术为何至今仍不完美,以及Rev如何在AI与人类协作中找到现实可行的路径。文章还原了他对ASR边界、语言复杂性和产品取舍的真实思考。

这是一篇来自一线参与者的反思:作为Sophia机器人前首席科学家,Ben Goertzel讲述了理想中的通用人工智能,如何在真实世界的硬件、算法与人性交汇处不断“碰壁”。比技术路线之争更重要的,是他对AGI伦理、情感机器人与现实工程限制的清醒认知。

Lex Fridman通过“苦涩教训”回顾了70年AI发展史,指出真正推动指数级进步的不是聪明算法,而是能持续放大算力的通用方法。视频从历史案例出发,讨论了算力、算法、数据与未来计算范式之间的张力。

在这段对话中,Alexa首席科学家Rohit Prasad直言:深度学习仍然强大,但无法独自解决“推理”这一终极难题。他结合Alexa的真实场景,解释了为什么下一代AI必须跨越预测,走向更接近人类目标理解的推理能力。

这段访谈记录了Alexa早期语音技术负责人Rohit Prasad讲述的一段关键历史:一支只有6人的团队,如何在几乎不被看好的情况下,依靠远场语音识别、深度学习和大规模数据,把“对着空气说话”从科幻变成真实产品。

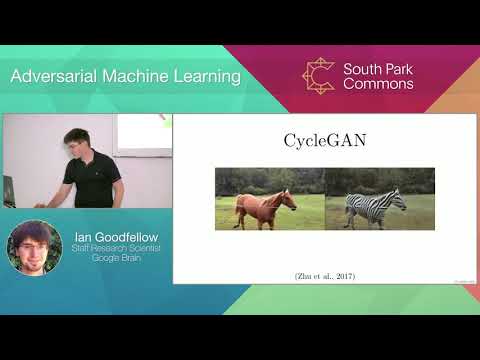

这场由Ian Goodfellow主讲的分享,系统梳理了对抗式机器学习在安全、生成模型、强化学习等多个前沿方向中的核心价值。演讲不仅回顾了技术爆发的背景,也坦率指出当前方法的局限,为理解“不可靠AI”的根源提供了难得的一手视角。

这是一段关于TensorFlow如何从Google内部的实验性工具,演变为全球机器学习基础设施的真实历史。Rajat Monga回顾了Google Brain早期的关键决策、开源背后的犹豫与勇气,以及TensorFlow 2.0为何必须“推倒重来”。

这是一堂来自MIT的导论课,Lex Fridman系统阐述了“以人为中心的人工智能”为何不是价值口号,而是技术必然。文章提炼其核心预测、方法论与真实案例,解释深度学习在现实世界为何离不开人。