他用Grok和Cursor现场做游戏:Vibe Coding正在重写开发门槛

不是教程,也不是Demo。Greg Isenberg在播客里直接打开Grok,把“做个游戏”的想法丢给AI,几分钟后,一个能跑、能调、能发布的小游戏就出现了。更狠的是:几乎没有传统意义上的编码。

不是教程,也不是Demo。Greg Isenberg在播客里直接打开Grok,把“做个游戏”的想法丢给AI,几分钟后,一个能跑、能调、能发布的小游戏就出现了。更狠的是:几乎没有传统意义上的编码。

一个开发者,用Next.js、GPT-4o和一堆“过度工程”,真的做出了会记得你生活细节、能隔三天接着聊的AI朋友。这不是情感噱头,而是一套可复用的AI应用范式:记忆、人格、结构化输出、真实感对话,全都落地了。

一边是前OpenAI CTO Mira Murati高调成立Thinking Machines Labs,却几乎不透露具体产品;另一边是曾被寄予厚望的AI硬件Humane Pin在一年内宣告失败。视频通过这两个对比鲜明的故事,揭示了当下AI创业中理想、资本与现实之间的张力。

基于Juan Peredo一年半构建生成式AI应用的真实经验,这篇文章系统梳理了从架构复杂度、模型部署、评估体系,到Agent成本与可观测性的关键教训,帮助开发者少走弯路,把GenAI真正落地为可靠产品。

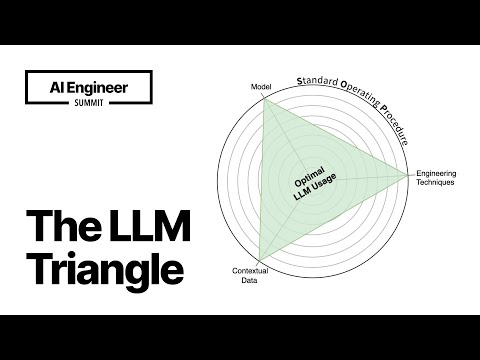

这场演讲并不是在教你“怎么调Prompt”,而是试图回答一个更难的问题:为什么90%的LLM应用死在生产环境。Almog Baku用工程师和创业者的视角,提出了“LLM三角”方法论——模型、工程技术、数据,在SOP的约束下协同工作,才可能构建稳定、可复现的AI应用。

这是一篇关于AI Agent如何被错误营销、以及这种叙事为何正在伤害开发者与产品本身的文章。来自前GitHub Copilot开发者布道师的亲身经验,提出了一套“克制而真实的拟人化”框架,帮助AI工具在获得采用率的同时,避免透支开发者信任。

这篇文章基于Theory Ventures合伙人Andy Tadman的演讲,系统拆解了“大语言模型在哪些工作上已经是超人级别”的判断方法。你将看到一套清晰的自动化评估框架,以及安全运营和客户营销两个真实案例,理解为什么真正被颠覆的不是“复杂工作”,而是“高频工作”。

这不是一场教你用框架的Agent演讲,而是一位工程师带你从最原始的循环、判断和工具调用开始,亲手“跑起来、弄坏它”,直到真正理解Agent为何会像一个能自主行动的系统。

这支视频讨论了一个常被忽视的问题:当大语言模型进入几乎没有训练数据的领域时,该如何继续发挥价值?作者提出了一种务实的方法——用“可验证的规则和经验法则”去弥补知识缺口,让模型在低知识密度领域依然具备可用的推理能力。

这场演讲提出了一个反直觉但极具现实意义的观点:企业AI落地的最大障碍不是模型能力,而是部署方式。Steven Moon主张,真正可规模化的AI代理,应该像员工一样工作在企业既有的安全边界内,而不是成为又一个需要审查的新系统。