Figma UI3 把“对齐”做到极致:这套设计逻辑正在重塑 AI 产品

大多数人以为 Figma 只是设计工具,但这支官方教学视频暴露了一个更深的事实:Figma UI3 的核心不是画界面,而是用“对齐、约束、结构”这套思维,把复杂系统驯化到可控状态。这对正在做 AI 产品的人,影响比你想的大得多。

大多数人以为 Figma 只是设计工具,但这支官方教学视频暴露了一个更深的事实:Figma UI3 的核心不是画界面,而是用“对齐、约束、结构”这套思维,把复杂系统驯化到可控状态。这对正在做 AI 产品的人,影响比你想的大得多。

很多开发者以为自己已经会用 Figma Dev Mode,但 Mark Foo 在这场 Demo 里抛出的观点很直接:Dev Mode 的价值,不在于“更快切图”,而在于让开发、设计、甚至 AI 协作第一次站在同一张地图上。这是一场关于效率、对齐,以及为什么你一直在做无用功的演示。

在经历了一段以风险、监管和末日叙事为主的AI讨论周期后,科技圈似乎正在重新拥抱乐观主义。《AI Daily Brief》通过近期几篇关键文章和事件,捕捉到这种“氛围转向”的细微变化,尤其是Anthropic CEO Dario Amodei对“如果一切顺利,AI世界会怎样”的大胆描绘。

OpenAI第二届DevDay几乎不谈消费者产品,也没有GPT-5,却释放出一个更重要的信号:AI正在从“更聪明的聊天机器人”转向“真正能行动、能规划的智能体”。本文还原发布会核心内容,解析实时语音、视觉微调、蒸馏与o1模型背后的战略转向。

Sam Altman在《The Intelligence Age》中描绘了一个由AI驱动的繁荣未来,并大胆预测“超级智能可能在几千天内到来”。这期视频不仅拆解了他的核心论点,也呈现了行业内对这次叙事转向的质疑、震惊与政治意味。

一个没有产品、没有 Demo、甚至还没公开技术路线的 AI 公司,刚刚拿到了 10 亿美元融资,估值约 50 亿美元。创始人是 Ilya Sutskever——OpenAI 的灵魂人物之一。更反直觉的是:这家公司只做一件事,而且明确表示不被商业化干扰。这不是融资新闻,这是一次对整个 AGI 路线的公开挑战。

大多数团队把产品评审做成了“汇报会”,而 Figma 在这场 Office Hours 里给出了一个反直觉答案:真正高质量的产品评审,往往不是为了当场拍板,而是为了制造共识、暴露分歧,甚至刻意延迟决策。这套方法,对 AI 团队尤其致命重要。

短短一年内,OpenAI 接连失去三位重量级高管:消费产品负责人突然离场,总裁兼联创休假,核心研究联创转投 Anthropic。这不是普通的人事变动,而是一连串足以动摇行业信心的信号。

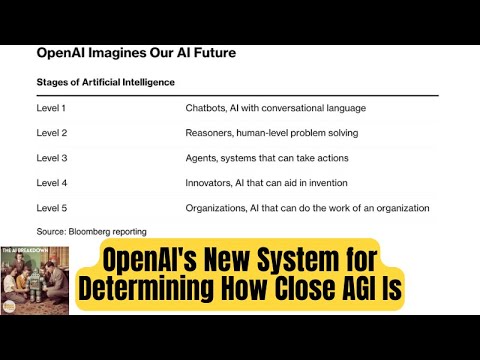

OpenAI在一次内部全员会议上,首次公开了一套“AGI分级系统”。更炸的是:他们认为自己正站在从聊天机器人迈向“人类级推理”的门槛上。这不仅重塑了我们理解AGI进度的方式,也暴露了OpenAI对风险、权力与监管的真实判断。

消失半年后,OpenAI 前首席科学家 Ilya Sutskever 终于现身——不是回归大厂,而是亲手创立一家“只做一件事”的公司:安全超级智能。没有产品、没有收入、没有妥协,这不是常规创业,而是一场对整个 AI 产业逻辑的挑战。