Mistral CEO亲述:开源不是口号,而是一种速度优势

这是一场关于“为什么要坚持开源”的深度对话。Mistral AI 创始人 Arthur Mensch 从创业动机、模型路线、开源与商业的边界谈起,解释了一家欧洲 AI 公司,如何用开源策略在速度、成本和生态上与巨头竞争。

这是一场关于“为什么要坚持开源”的深度对话。Mistral AI 创始人 Arthur Mensch 从创业动机、模型路线、开源与商业的边界谈起,解释了一家欧洲 AI 公司,如何用开源策略在速度、成本和生态上与巨头竞争。

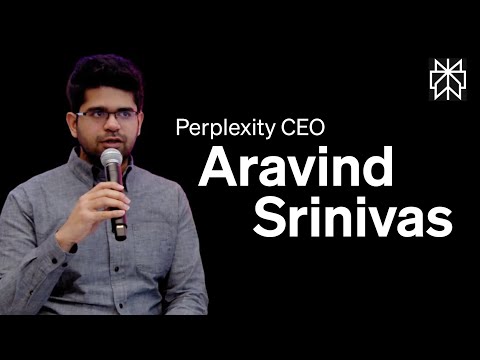

很多人以为 Perplexity 是“又一个 AI 搜索引擎”,但 CEO Aravind Srinivas 在 Stripe 的这场对话里反复强调:他们赢的不是模型,而是推理方式、工程文化和一系列看似无聊却致命的选择。更反直觉的是,Perplexity 并非从搜索起步,却可能最早重塑搜索的终局。

不是要开源,也不是要停六个月。这一次,250多位AI研究员把矛头对准OpenAI、Meta等巨头,要求给独立研究者一个“安全检查入口”。这封信的真正震撼之处,在于它正在重新定义:谁有资格审计AI,以及谁在为AI安全买单。

不是黑客入侵,也不是高深间谍战,而是一名谷歌工程师,把核心AI机密复制进 Apple Notes,再转成 PDF 带走。这起看似“低级”的泄密案,却引发了美国司法部、FBI、商务部的联合重拳,也第一次如此清晰地告诉整个行业:AI,已经正式升级为国家安全资产。

如果你只用一个词形容 2024 年 2 月的 AI 圈,那只能是:失控。Google 被自己的模型反噬,OpenAI 把视频生成直接推到“真假难辨”,而真正改变游戏规则的,可能是那个很多人低估的“100 万 Token”。这不是新闻合集,而是一份行业人必须消化的月度信号弹。

所有人都在担心被AI取代,但MIT的一项研究给出了一个反直觉答案:不是AI太慢,而是它在大多数岗位上“不划算”。真正决定你工作命运的,不是模型能力,而是一笔冷冰冰的成本账。

2023年的AI,不是线性进步,而是连续“事故现场”。从Bing Chat当众失控,到GPT-4把世界吓了几个月,再到Sam Altman被解雇又火速回归,真正塑造这一年的,不只是技术突破,而是一连串让行业神经紧绷的意外事件。

原定年度最重要发布,Google 却在最后一刻取消 Gemini 的线下预览,只改成“可能上线”的线上展示。原因并不体面:模型在多语言场景下还不够稳,而外界盯着的对手,正是 GPT‑4。这不是一次普通跳票,而是一次巨头在 AI 竞赛中罕见的迟疑。

当所有人还在争论“AI 视频什么时候能用”,Pika 1.0 已经把答案拍在桌面上:现在就能。更关键的是,它暴露了一个被低估的事实——AI 视频的拐点,可能不是模型能力,而是创作权力的下放。

当苹果在发布会上两次说出“AI”这个词,整个行业都愣了一下。不是因为参数有多炸,而是因为这家公司过去十年几乎刻意回避AI叙事。这一次,M3 Max不只是新芯片,而是苹果对AI战争的首次正面回应。