1万亿参数、4000种语言,AI竞赛正在突然变向

当所有人以为“大模型只会越来越大”,Intel却拿出1万亿参数押注科学研究;Meta用《圣经》训练出覆盖4000种语言的语音模型;而一篇论文却告诉行业:少量微调,反而赢过GPT‑4。这不是热闹,而是方向改变的信号。

当所有人以为“大模型只会越来越大”,Intel却拿出1万亿参数押注科学研究;Meta用《圣经》训练出覆盖4000种语言的语音模型;而一篇论文却告诉行业:少量微调,反而赢过GPT‑4。这不是热闹,而是方向改变的信号。

Hugging Face 并非一开始就要做“AI 的 GitHub”。从一次展会上的偶遇、一个无聊的 AI 助手想法,到押注开源 Transformer,这家公司走出了一条高度非线性的路径。本文还原 Clem Delangue 的真实叙述,讲清 Hugging Face 为什么能成为开源 AI 的核心基础设施。

美国参议院第一次在 ChatGPT 时代认真讨论 AI,结果却和很多人想的不一样:几乎没人质疑 AI 的颠覆性,真正的焦虑来自社交媒体留下的“历史创伤”。从 Section 230 到新 AI 监管机构,这场听证会正在悄悄决定未来十年 AI 的游戏规则。

如果你以为ChatGPT已经是AI的终局,那你可能低估了这一波技术浪潮的速度。就在多数人沉迷Prompt技巧时,OpenAI、Anthropic 和 Meta 已经同时向前迈了一步:搞懂模型、约束模型、以及——超越语言模型本身。

一封来自Google内部的泄密备忘录,直言“我们没有护城河,OpenAI也没有”。更残酷的是:击败巨头的不是另一家大公司,而是一群拿着开源模型、几百美元预算的开发者。这不是情绪宣泄,而是一份冷静到刺骨的行业判决书。

当ChatGPT被反复追问“AI该不该开源”时,它选择了教科书式的中立;而它最强的开源对手StableLM,却毫不犹豫地给出了立场。这不是一次简单的模型对比,而是一次关于权力、商业与未来AI走向的正面碰撞。

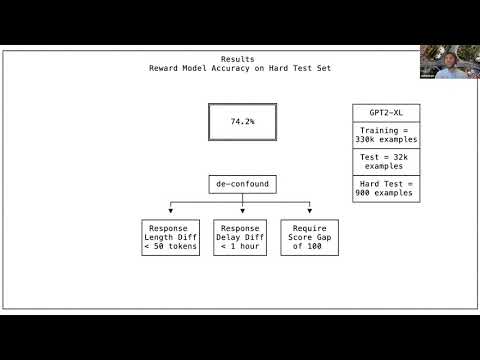

OpenAI 学者 Jonathan Ward 做了一件反直觉的事:不用人工标注、不请外包标注员,而是直接拿互联网的“点赞”来训练奖励模型。结果很震撼——模型学会了人类偏好,但准确率卡在了 74%。这背后,藏着今天所有 RLHF 系统的真相与瓶颈。

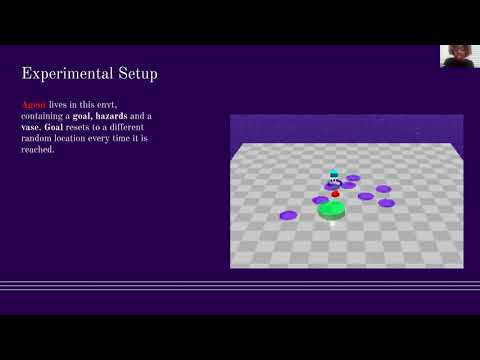

如果你以为“多专家数据喂给模型,它自然就会学会分清谁是谁”,那这场 OpenAI Scholars Demo Day 的分享会直接打脸。Tyna Eloundou 用一个看似优雅、实则极具野心的框架,展示了:我们不仅能让模型学到多种行为,还能在需要时精准切换它们。

这是一场典型“工程师视角”的AI工作坊。Daniel Han不追逐概念热词,而是从开源模型的真实演进出发,串起微调、人类反馈强化学习(RHF)、经典强化学习,再落到量化等工程取舍,帮助听众理解:今天的大模型能力,究竟是如何一步步被“驯化”出来的。