OpenAI风波之后:治理、开源与AI下一阶段的真实信号

在这期《No Priors》少见的双主持对谈中,Sarah Guo 与 Elad Gil 复盘了 OpenAI 的董事会风波,并由此延伸出对 AI 公司治理、开源模型、视频生成以及大模型技术路径的关键判断。这不仅是一次事件复盘,更是一张理解 AI 行业下一阶段走向的路线图。

在这期《No Priors》少见的双主持对谈中,Sarah Guo 与 Elad Gil 复盘了 OpenAI 的董事会风波,并由此延伸出对 AI 公司治理、开源模型、视频生成以及大模型技术路径的关键判断。这不仅是一次事件复盘,更是一张理解 AI 行业下一阶段走向的路线图。

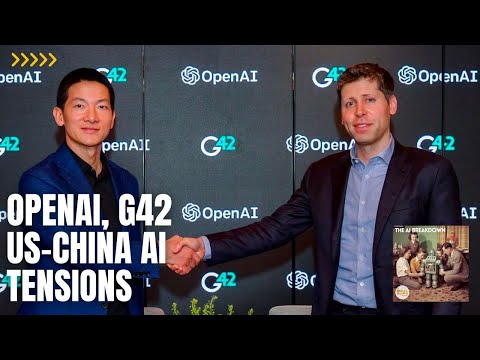

OpenAI 一次看似普通的中东合作,把自己推到了中美 AI 对抗的火线上。芯片、主权基金、情报机构、Sam Altman 的融资野心,全都纠缠在一起——这不是八卦,而是每个 AI 从业者都绕不开的现实。

Sam Altman 被董事会突然解雇,又在五天后王者归来,这不是一场普通的人事风波,而是一次把 OpenAI 内部权力、AI 安全分歧和硅谷治理矛盾全部暴露在阳光下的“行业级事故”。真正的赢家和输家,其实比表面复杂得多。

OpenAI董事会刚炒掉Sam Altman,员工却集体“逼宫”,微软趁机接盘,前Twitch CEO空降掌舵——这不是宫斗八卦,而是一场关于AI控制权、算力与安全话语权的公开撕裂。读完你会明白:谁在真正决定AI的未来。

Sam Altman被董事会“闪电解雇”不到48小时,剧情却急转直下:硅谷把这当成一场战争,资本、员工、微软同时下场。这不是八卦,而是一堂关于权力、治理和AI命脉的现实课。

一场毫无预警的董事会决定,让硅谷市值瞬间蒸发数百亿美元。Sam Altman被解雇、Greg Brockman愤而离场、微软震怒——这不是八卦,而是一次关于“AI该跑多快”的正面冲突。

没有预告、没有缓冲,OpenAI 董事会在一个交易日内“直接动手”,把 Sam Altman 从 CEO 位置上拉了下来。公告措辞异常冷酷,市场瞬间震荡,微软市值蒸发数百亿美元。更重要的是:这不像普通的高管更替,而像一次对“AI 未来方向”的强制纠偏。

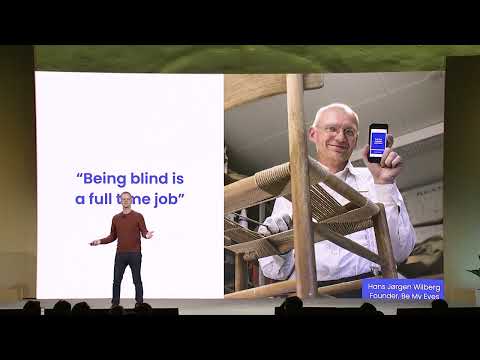

在 OpenAI DevDay 上,一个最容易被忽略的 Demo 给了 AI 从业者当头一棒:真正落地的多模态 AI,不是炫技,而是让 9 成用户不再需要“找人帮忙”。这一次,GPT-4V 没有展示未来,而是直接改变了现实。

Custom GPT 被骂成“高级提示词”“玩具应用”,但这恰恰是最危险的误解。这段来自 The AI Daily Brief 的视频给出了一个反直觉结论:Custom GPT 的价值不在技术突破,而在认知迁移。看懂这一点,才算真的看懂 OpenAI 的下一步。

很多人以为这是一场“新功能发布会”,但看完你会发现:OpenAI其实在悄悄重构ChatGPT的角色——从聊天工具,变成可以被任何人定制、接入现实世界、真正执行任务的AI Agent平台。这一次,变化比模型升级更大。