对比学习在语言上翻车了?OpenAI 学者的实验揭示一个被忽视的难题

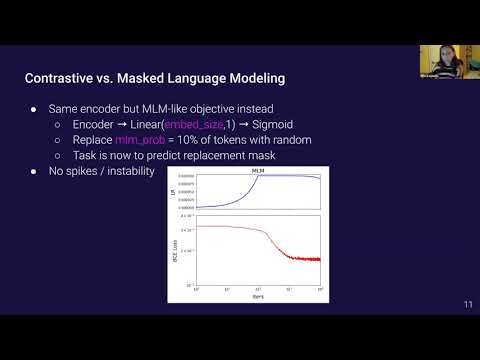

在计算机视觉里横扫榜单的对比学习,一搬到自然语言却问题频出。OpenAI Scholars Demo Day 上,Ellie Kitanidis 公开了一次并不“完美”的尝试:用对比学习预训练语言模型。真正的猛料不在结果,而在她暴露出的那个几乎所有语言模型都会撞上的隐形难题。

在计算机视觉里横扫榜单的对比学习,一搬到自然语言却问题频出。OpenAI Scholars Demo Day 上,Ellie Kitanidis 公开了一次并不“完美”的尝试:用对比学习预训练语言模型。真正的猛料不在结果,而在她暴露出的那个几乎所有语言模型都会撞上的隐形难题。

诺贝尔奖得主丹尼尔·卡尼曼在与Lex Fridman的对话中,用“系统一/系统二”框架重新审视当代AI。他认为深度学习取得了惊人的速度型成功,却仍缺乏因果、意义与世界理解能力。这场对话为理解AI的边界与下一步提供了极具洞见的视角。

在与 Lex Fridman 的对话中,Gary Marcus 系统性地反思了深度学习的边界。他认为,当前 AI 最大的瓶颈不在算力或数据,而在缺乏“常识”和可解释的认知模型。本文提炼了他最关键的洞见、经典案例与争议观点。

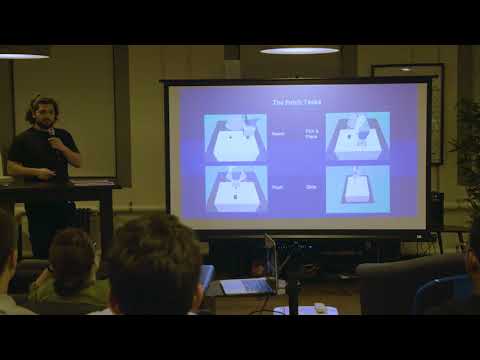

如果你以为“学会世界模型,强化学习就起飞了”,这场 OpenAI 内部分享会当头泼了一盆冷水。Alex Botev 用真实的机器人实验告诉你:模型不是越强越好,关键在于怎么用。更重要的是,他给出了一条现实可行的折中路线。

在这场MIT AGI系列演讲中,OpenAI联合创始人Ilya Sutskever系统阐述了他对通用人工智能的核心判断:为什么神经网络是基础,强化学习和元学习将改变能力边界,以及自博弈和AI安全在终局阶段的重要性。这是一份来自一线研究者的思考框架,而非事后总结。

这篇文章还原了MIT 6.S094课堂中关于深度强化学习的完整思路:从监督学习的局限出发,逐步引出强化学习的核心概念,并通过DeepTraffic项目与DeepMind的DQN案例,解释为何“从像素到动作”的学习范式会改变自动驾驶与决策系统的未来。

这场由CMU教授Ruslan Salakhutdinov主讲的演讲,系统梳理了无监督深度学习的发展脉络。从早期的稀疏编码、自编码器,到生成模型与GAN,他反复追问一个核心问题:在没有标签的情况下,我们是否真的能学到有用的表示?