为什么最聪明的AI团队,反而要一起犯错?Figma演讲给出的反直觉答案

你可能以为,协作的终点是效率和共识。但在这场 Figma Config 的演讲里,Nikolas Klein 抛出了一个让人不安却极其重要的观点:真正的创造力,来自“一起失败”。这不是鸡汤,而是一套可以直接迁移到 AI 团队的协作方法论。

你可能以为,协作的终点是效率和共识。但在这场 Figma Config 的演讲里,Nikolas Klein 抛出了一个让人不安却极其重要的观点:真正的创造力,来自“一起失败”。这不是鸡汤,而是一套可以直接迁移到 AI 团队的协作方法论。

在一场看似讲设计系统的分享里,Stripe 设计师抛出了一个对所有技术人都刺耳的观点:真正决定产品成败的,往往不是快,而是长期、克制和对细节近乎偏执的严苛。这场 Config 2021 的演讲,意外地给了 AI 从业者一套可迁移的思维模型。

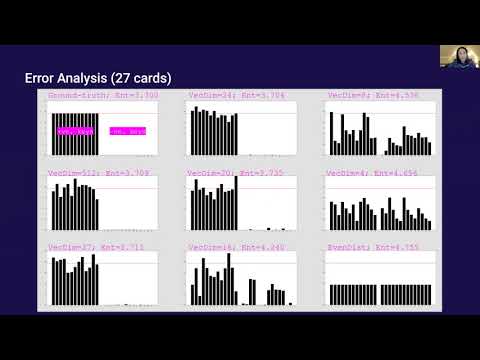

CLIP这类对比学习模型,被认为是多模态时代的基石。但在一个看似“玩具”的SET纸牌游戏里,它却暴露出一个致命短板:当关系、属性和实体一多,向量维度不够,模型会系统性失明。这不是调参问题,而是容量上限。

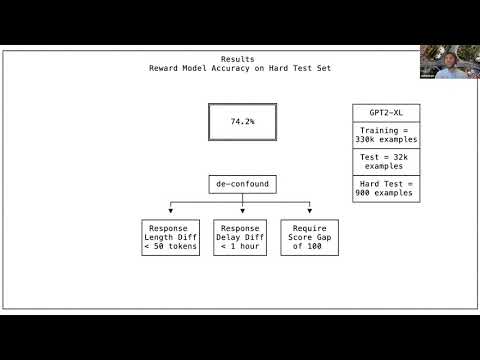

OpenAI 学者 Jonathan Ward 做了一件反直觉的事:不用人工标注、不请外包标注员,而是直接拿互联网的“点赞”来训练奖励模型。结果很震撼——模型学会了人类偏好,但准确率卡在了 74%。这背后,藏着今天所有 RLHF 系统的真相与瓶颈。

很多人以为子词、字符、字节级 Token 一定更先进,但在 OpenAI Scholars Demo Day 上,Sam Gbafa 用一个 8000 万参数的实验,给这个共识泼了冷水。结果不但反直觉,还直接影响你今天怎么选 tokenizer、怎么配上下文窗口。

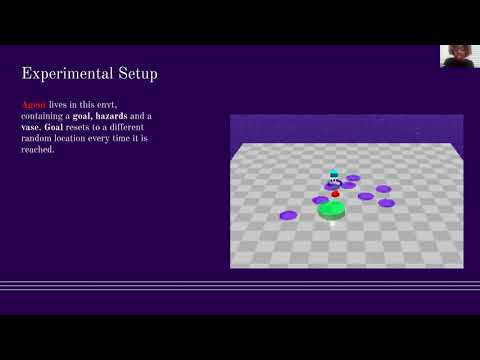

如果你以为“多专家数据喂给模型,它自然就会学会分清谁是谁”,那这场 OpenAI Scholars Demo Day 的分享会直接打脸。Tyna Eloundou 用一个看似优雅、实则极具野心的框架,展示了:我们不仅能让模型学到多种行为,还能在需要时精准切换它们。

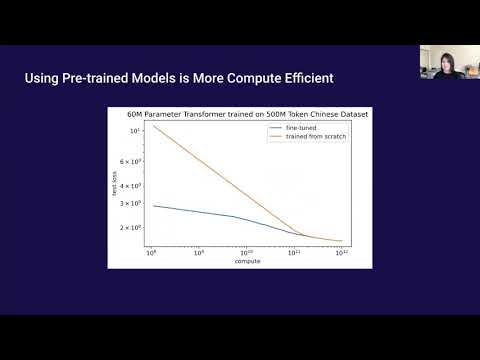

很多人直觉认为:只要模型够大、预训练够久,语言迁移自然水到渠成。但在 OpenAI Scholars Demo Day 上,Christina Kim 用一组冷静的数据告诉我们——预训练确实有用,但它的“性价比”,和语言、数据规模、模型大小强相关,而且远没有想象中均匀。

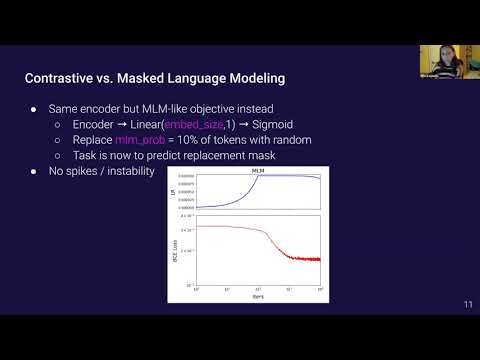

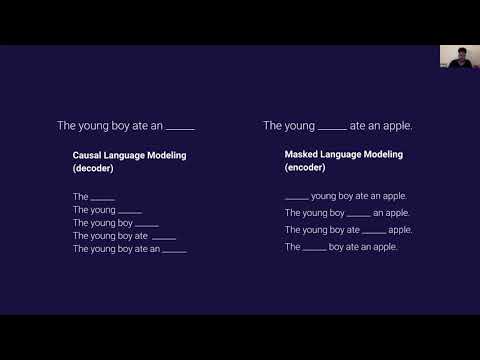

在计算机视觉里横扫榜单的对比学习,一搬到自然语言却问题频出。OpenAI Scholars Demo Day 上,Ellie Kitanidis 公开了一次并不“完美”的尝试:用对比学习预训练语言模型。真正的猛料不在结果,而在她暴露出的那个几乎所有语言模型都会撞上的隐形难题。

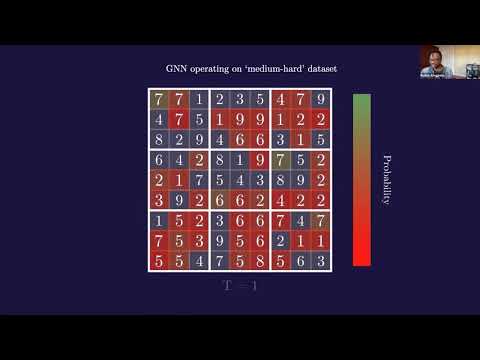

很多人以为模型一旦训练完,推理阶段只能“照章办事”。但在这场 OpenAI Scholars Demo Day 的分享里,研究者直接挑战了这个假设:在图结构问题上,测试时多给一点计算,模型真的会变聪明,而且不只是玄学提升。

我们习惯相信:模型越大,效果越好。但在这场 OpenAI Scholars Demo Day 的分享中,一个关键前提被悄悄动摇——Scaling Laws 可能并不“公平”对待所有 Transformer 架构。Shola Oyedele 用一组克制却锋利的实验,揭开了架构选择背后的成本与收益真相。