一周AI最大反转:游戏先点燃了下一代人工智能

如果你还以为AI的主战场在写代码和写文案,这周的新闻会狠狠打脸你。Unity、NVIDIA、Google、Apple,从游戏平台到3D世界,再到多模态与AI对齐,真正被点燃的是“可交互的AI世界”。这不是小趋势,而是方向级变化。

如果你还以为AI的主战场在写代码和写文案,这周的新闻会狠狠打脸你。Unity、NVIDIA、Google、Apple,从游戏平台到3D世界,再到多模态与AI对齐,真正被点燃的是“可交互的AI世界”。这不是小趋势,而是方向级变化。

OpenAI 最近抛出一个看似低调、实则可能改变模型训练逻辑的研究:不再只奖励“正确答案”,而是逐步奖励“思考过程”。更反直觉的是,这不仅让 GPT 数学更强,还可能降低幻觉、改善 AI 对齐,被称为罕见的“负对齐税”进展。

如果我告诉你:AI已经能在你什么都不说的情况下,把你“看到的画面”复原成视频,你会觉得这是噱头还是失控的前夜?这项名为 Mind Video 的研究,正在把“读心术”从科幻拖进现实,而且速度比大多数人想象得更快。

真正的AI爆发点,可能不是模型再强一点,而是“几乎不用学就能用”。微软在Build大会上的一连串动作,谷歌让Bard变得能看图,Anthropic融资4.5亿美元——这些信号拼在一起,指向同一件事:AI正在跨过极客门槛,走向大众。

当所有人以为“大模型只会越来越大”,Intel却拿出1万亿参数押注科学研究;Meta用《圣经》训练出覆盖4000种语言的语音模型;而一篇论文却告诉行业:少量微调,反而赢过GPT‑4。这不是热闹,而是方向改变的信号。

一边是Meta高调宣布自研AI芯片和超级算力,一边是Apple悄悄封禁ChatGPT、同时被曝在内部憋大招,而纽约公立学校却反向操作,重新拥抱生成式AI。这不是零散新闻,而是一场正在成型的“AI基础设施战争”。

插件不是给ChatGPT“加功能”,而是把它从聊天机器人推向“可执行系统”。从买菜、订机票,到金融研究、代码分析,这一波插件真正改变的,是AI与现实世界的连接方式。

如果你觉得AI的进化是“渐进式”的,那这一周的新闻会直接打脸。从OpenAI把文字变成3D物体,到Hugging Face让模型开始“自己干活”,再到上下文窗口、视觉语言模型的集体跃迁,AI不只是更聪明了,而是正在换一种存在方式。

如果你以为ChatGPT已经是AI的终局,那你可能低估了这一波技术浪潮的速度。就在多数人沉迷Prompt技巧时,OpenAI、Anthropic 和 Meta 已经同时向前迈了一步:搞懂模型、约束模型、以及——超越语言模型本身。

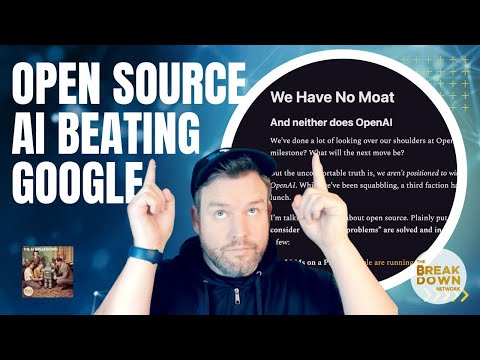

一封来自Google内部的泄密备忘录,直言“我们没有护城河,OpenAI也没有”。更残酷的是:击败巨头的不是另一家大公司,而是一群拿着开源模型、几百美元预算的开发者。这不是情绪宣泄,而是一份冷静到刺骨的行业判决书。