D&D一句“禁用AI作画”,撕开了生成式AI最危险的裂缝

Dungeons & Dragons 突然宣布:未来官方美术全面禁用 AI。导火索只是“一根多出来的手指”,但真正被点燃的,是艺术、版权、披露义务,以及“人类还能不能识别AI”的系统性危机。这不是一场游戏圈内斗,而是所有 AI 从业者都绕不开的现实预演。

Dungeons & Dragons 突然宣布:未来官方美术全面禁用 AI。导火索只是“一根多出来的手指”,但真正被点燃的,是艺术、版权、披露义务,以及“人类还能不能识别AI”的系统性危机。这不是一场游戏圈内斗,而是所有 AI 从业者都绕不开的现实预演。

一行条款更新,让Zoom被骂成“NSA 2.0”;一个新爬虫发布,又把OpenAI推上数据争议前线。AI模型还在疯狂进化,但训练数据的“合法性”和“信任”正在成为真正的瓶颈。这不是隐私恐慌,而是一场正在发生的范式转移。

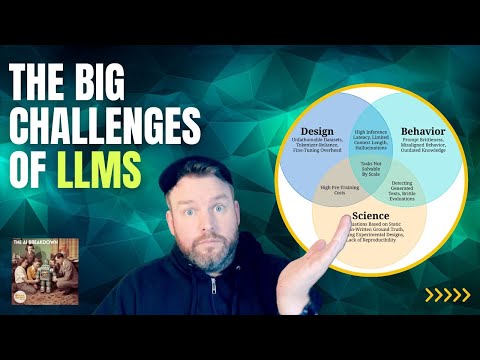

很多人第一次用 ChatGPT 时都有一种错觉:语言智能的问题,好像已经被解决了。但一篇由剑桥、UCL、Meta AI 等机构联合完成的论文却泼了一盆冷水——我们可能才刚刚站在起点。真正的挑战,不是“模型不够大”,而是一整套尚未被驯服的复杂系统问题。

一群最担心AI灭绝人类的人,恰恰也是最努力推进AI的人。这不是伪善,而是一套你必须理解的内在逻辑。从“我做的并不危险”,到“就算毁灭也值得”,这期视频把行业里最不愿摊开的动机,全部摆到了台面上。

当微软、谷歌在生成式AI舞台上正面厮杀时,苹果却像“消失”了一样。但财报、招聘和内部工具透露出一个反直觉的真相:苹果不仅没缺席,还可能在准备一条完全不同、而且更危险的AI路线。

我们总以为AI失业潮是遥远的社会问题,但《The AI Daily Brief》提出了一个更危险的判断:真正被AI威胁的,是政治上最有资源、最有话语权、也最不可能沉默的那群人。这不是就业问题,而是一场即将到来的政治风暴。

一夜之间,科学家、工程师和AI从业者同时盯上了一种名为LK-99的材料。它被宣称能在常温常压下实现超导,也被质疑数据站不住脚、作者关系扑朔迷离。这不只是一次材料学争议,更可能牵动AI算力、能源与科研体系的底层逻辑。

Twitter 上大多数内容的真实命运是:0点赞、0转发。Greg Isenberg 直接戳破这个残酷现实,并给出一套他亲自验证过的内容生成框架——从“随手记下一个念头”,到“验证、放大,甚至做成生意”。这不是鸡汤,而是一套可复制的创作者与 AI 从业者必备方法论。

在这期《Summer AI Technical Roundup》里,一个看似随口的判断却引爆了技术圈:Code Interpreter,可能才是真正的“GPT‑4.5”。这不是市场话术,而是关于推理能力、产品形态、AI安全与开源路线的一次深度对话。如果你以为模型升级只看参数规模,这期内容会直接颠覆你的判断。

很多人以为财富自由的终点是“少工作、多躺平”,但 Greg Isenberg 在这期对话里抛出了一个更残酷的视角:真正的差距,不在你赚了多少钱,而在于你每一单位注意力,能撬动多少回报。这套思路,正在悄悄改变创作者、创业者,甚至 AI 从业者的游戏规则。