从3.5天工作制到全程被记录:AI正在重塑工作的边界

这期《AI Daily Brief》串联了四个看似分散却高度相关的信号:顶级银行CEO对3.5天工作制的判断、微软Recall引发的“全景监控”争议、Rabbit R1的Agent实验,以及中国研究者在推理模型上的新突破。它们共同指向一个问题:当AI能力指数级提升,我们是否准备好重写工作、隐私与技术演进的默认规则?

这期《AI Daily Brief》串联了四个看似分散却高度相关的信号:顶级银行CEO对3.5天工作制的判断、微软Recall引发的“全景监控”争议、Rabbit R1的Agent实验,以及中国研究者在推理模型上的新突破。它们共同指向一个问题:当AI能力指数级提升,我们是否准备好重写工作、隐私与技术演进的默认规则?

这期《The AI Daily Brief》用一连串产品更新,勾勒出一个清晰趋势:对话式AI Agent正在从概念走向基础设施。无论是ElevenLabs下场做完整Agent管线,还是Mistral补齐多模态与工作流能力,都在指向同一个信号——AI Agent不再是噱头,而是新一代应用的默认形态。

当Anthropic的Claude在AI研究测试中击败OpenAI模型,这并不只是一次榜单胜负,而是一次关于“AI是否开始参与改进AI”的关键实验。本文结合多项基准测试与一线观察,梳理自我改进AI的真实进展、瓶颈与下一阶段竞争焦点。

Meta Connect 2024 上,真正的主角并不是某个参数爆炸的模型,而是扎克伯格本人。他一边用 Llama 3.2 夯实“开源 AI 基础设施”,一边用 Orion AR 眼镜重新点燃 Meta 最初的愿景。这场发布会,像极了当年乔布斯把技术、产品与长期叙事绑在一起的时刻。

如果你还以为 Apple 会靠自研模型悄悄逆袭生成式 AI,那这条消息会直接把你拉回现实:苹果正在和 Google 谈判,把 Gemini 放进 iPhone。这不是简单的技术合作,而是一次战略“认怂”,也可能是 Siri 重生、AI 竞争格局重排的关键一枪。

当所有人还在盯着GPT-4、Gemini Ultra谁更强时,OpenAI已经悄悄把战场往前推了一步:让AI不再“回答问题”,而是直接替你干活。这不是一个新模型的故事,而是一次对人类使用电脑方式的正面进攻。

Gemini 发布当天,谷歌看起来终于追上了 GPT-4,但48小时后,风向突变:最火的多模态演示被扒出是“后期剪辑”。这不只是一次公关翻车,而是一次关于 AI 竞赛、信任与现实落差的集体清醒。

OpenAI Dev Day 刚用 GPT-4 Turbo 和 128K 上下文窗口点燃整个行业,转头大家却发现:那个被寄予厚望、号称能正面挑战 GPT-4 的 Google Gemini,又延期了。这不是一次普通的产品跳票,而是谷歌在 AI 时代最尴尬的一次集体等待。

在 OpenAI DevDay 的舞台上,Chad Nelson 抛出了一个反直觉的结论:AI 没有替代创意,反而让创意第一次真正“分叉生长”。他展示的不是效率提升,而是一种全新的创作范式——这对每一个 AI 从业者、产品人和创意工作者,都是一次认知刷新。

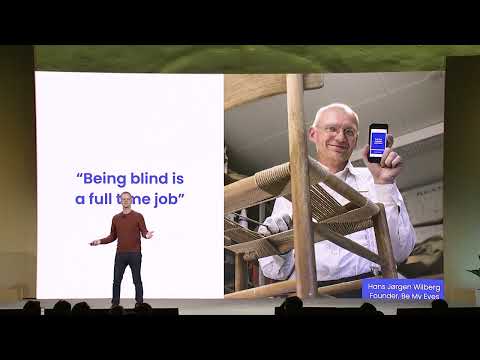

在 OpenAI DevDay 上,一个最容易被忽略的 Demo 给了 AI 从业者当头一棒:真正落地的多模态 AI,不是炫技,而是让 9 成用户不再需要“找人帮忙”。这一次,GPT-4V 没有展示未来,而是直接改变了现实。