Claude 2 真正威胁 GPT-4 的,不是智商,而是这三件事

GPT-4 终于迎来了一个“不像陪跑者”的对手。Anthropic 推出的 Claude 2,在考试成绩上紧追不舍,却在上下文窗口、价格和安全哲学上走了一条完全不同的路。这不是一次普通的模型升级,而是一次对 OpenAI 统治地位的正面冲击。

GPT-4 终于迎来了一个“不像陪跑者”的对手。Anthropic 推出的 Claude 2,在考试成绩上紧追不舍,却在上下文窗口、价格和安全哲学上走了一条完全不同的路。这不是一次普通的模型升级,而是一次对 OpenAI 统治地位的正面冲击。

Google说Bard一夜之间“聪明了30%”,Sam Altman却反复强调GPT‑5还没开始训练;一边是算法突进,一边是监管、诉讼和开源失控的暗流。这不是一次产品更新,而是AI竞赛规则正在改变的信号。

过去几周,大量资深用户同时发出同一个疑问:ChatGPT,尤其是 GPT-4,是不是变笨了?代码写不对、上下文抓不住、反复道歉却不改错。就在质疑声最高涨时,OpenAI 发布了一份“提示工程最佳实践”指南——这更像是在回应争议,也引发了更大的讨论:问题到底出在模型,还是出在我们?

当谷歌、微软在开发者大会上疯狂堆叠AI叙事时,苹果在WWDC上选择了“只字不提AI”。没有大模型发布,没有生成式搜索,甚至连“人工智能”这个词都没出现。但正是这种反常识的克制,暴露了苹果一条更长线、也更危险的AI路线图。

Hugging Face 并非一开始就要做“AI 的 GitHub”。从一次展会上的偶遇、一个无聊的 AI 助手想法,到押注开源 Transformer,这家公司走出了一条高度非线性的路径。本文还原 Clem Delangue 的真实叙述,讲清 Hugging Face 为什么能成为开源 AI 的核心基础设施。

AI 能把你“想的内容”变成文字了,而且不是关键词匹配,而是理解语义后的复述。这项登上《Nature Neuroscience》的研究,让无数人第一次认真思考:大模型和人脑,可能比我们想象的更像。

Lex Fridman 通过 Pixel 6 的一次“AI 开箱”,讲清了智能手机竞争正在从参数堆叠,转向以 AI 芯片为核心的体系之争。这不仅是一次硬件评测,更是一份关于边缘 AI、异构计算与未来人机关系的思考。

这不是一次普通的产品发布,而是 OpenAI 当众展示:一个模型如何在一年内,从“代码准确率 0%”,进化到能写服务器、接 API、做小游戏。更反直觉的是,Ilya 亲口承认:这一切的原理,其实简单到令人不安。

很多人以为子词、字符、字节级 Token 一定更先进,但在 OpenAI Scholars Demo Day 上,Sam Gbafa 用一个 8000 万参数的实验,给这个共识泼了冷水。结果不但反直觉,还直接影响你今天怎么选 tokenizer、怎么配上下文窗口。

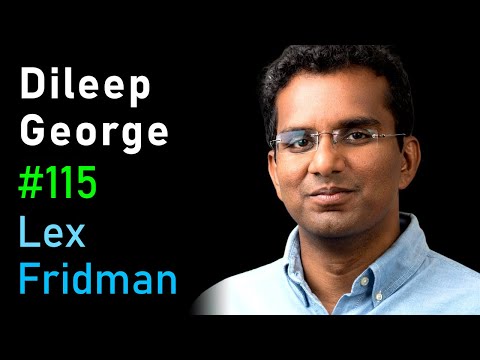

在这期Lex Fridman播客中,Dileep George系统阐述了他对“类脑AI”的核心信念:不理解大脑,就难以构建真正具备推理能力的智能系统。本文提炼他关于皮层结构、反馈连接以及与GPT-3差异的关键洞见。