开源AI不是风险,而是底牌?a16z、Meta与经济学人罕见正面交锋

如果你以为“开源AI威胁国家安全”已经是共识,那你可能落后了一轮讨论。a16z合伙人、Berkeley教授、Meta创始人和《经济学人》罕见同台,从Linux、密码学一路吵到Llama模型权重,真正的分歧不在开源,而在“模型能力”这条隐形红线。

如果你以为“开源AI威胁国家安全”已经是共识,那你可能落后了一轮讨论。a16z合伙人、Berkeley教授、Meta创始人和《经济学人》罕见同台,从Linux、密码学一路吵到Llama模型权重,真正的分歧不在开源,而在“模型能力”这条隐形红线。

过去几个月,AI 的进化不像升级,更像“换物种”。ChatGPT 终于上线被反复跳票的高级语音模式,第一次让人觉得:它不是在“回答”,而是在“对话”。与此同时,Midjourney 6.1 几乎抹平了 AI 图像与摄影之间的界线。这两件事放在一起看,释放出一个危险又兴奋的信号:多模态,已经进入真实可用阶段。

前Shopify AI负责人、现OpenAI产品负责人Miqdad Jaffer,分享了他在真实商业场景中构建AI产品的方法论:接受不确定性、让用户始终掌控、从最小可用价值出发,而不是迷信宏大战略。

一条从 4chan 流出的基准测试,把整个 AI 圈炸醒了:Meta 的 Llama 3.1 405B,可能在多个核心指标上击败 GPT‑4o 和 Claude 3.5 Sonnet。更重要的不是“谁更强”,而是——这一次,站在最前面的,可能是开源模型。

就在拜登的AI行政令还在影响创业公司生死线时,特朗普阵营的一份“未公开草案”突然被曝光:要废旧立新、搞AI版“曼哈顿计划”。这不是简单的党争,而是一次将开源、算力、国家安全全部拉上台面的正面冲突。

在AI监管呼声最高涨的时候,特朗普的副总统候选人JD·万斯却公开站队“开源AI”,甚至直言:解决AI风险的办法不是监管,而是开源。这不是一句口号,而是一条可能彻底改变AI产业权力结构的政治信号。

OpenAI内部一个被反复否认、又反复被曝光的项目,终于有了新名字:Strawberry。它不是更聪明的聊天机器人,而是一次对“推理、规划、长期任务”的正面进攻。这篇文章带你梳理Q*的前世今生,以及它为什么可能是Agent时代真正的起点。

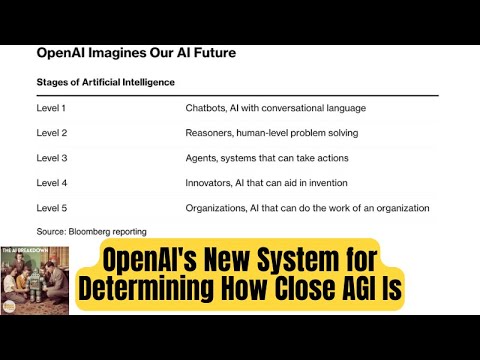

OpenAI在一次内部全员会议上,首次公开了一套“AGI分级系统”。更炸的是:他们认为自己正站在从聊天机器人迈向“人类级推理”的门槛上。这不仅重塑了我们理解AGI进度的方式,也暴露了OpenAI对风险、权力与监管的真实判断。

在 Figma Config 2024 的舞台上,一个会讲笑话、会写诗、还能害羞的火箭玩具登场了。但真正让台下的 AI 从业者安静下来的,不是它有多聪明,而是它背后那套“为孩子设计的 AI 安全系统”。

当所有人都在争论大模型参数和算力时,美联储主席鲍威尔却公开谈起了生成式AI。这不是一次随口评论,而是一次“风险雷达”的启动:就业、通胀、资产泡沫、地缘竞争,AI 正被放进央行级别的沙盘里重新审视。