3到6个月,AI写90%代码:Anthropic CEO的激进预言意味着什么

Anthropic CEO Dario Amodei在一次公开访谈中预测:3到6个月内,AI将编写90%的代码,一年内接近100%。这不仅是一次时间表的更新,更暴露出软件工程范式、创作者形态与工程师角色正在发生的深层转变。

Anthropic CEO Dario Amodei在一次公开访谈中预测:3到6个月内,AI将编写90%的代码,一年内接近100%。这不仅是一次时间表的更新,更暴露出软件工程范式、创作者形态与工程师角色正在发生的深层转变。

Figma创始人兼CEO Dylan Field在YC的对谈中,分享了他对AI、设计角色与软件未来的关键判断。从“想法迷宫”到“锁定优势”,这是一套只有亲历者才能讲清的设计与创业方法论。

这场工作坊围绕Model Context Protocol(MCP)展开,系统解释了为什么“上下文”正在成为AI应用的核心基础设施。演讲者不仅讲清了MCP要解决的问题,还通过构建Agent的全过程,展示了一种不同于传统Prompt工程的新范式。

OpenAI 发布 GPT‑4.5,本以为是“最强大脑”,结果却成了“高情商选手”。它更会聊天、更懂情绪,却未必更会写代码。这一次升级,不只是一款模型的变化,而是 OpenAI 对 AI 路线的一次明确表态。

如果你还以为 AI 编程只是“补全几行代码”,这条视频会直接打脸。Mckay Wrigley 用 Claude 3.7 Sonnet 搭配 Cursor Agent,从一个空文件夹开始,几乎不写代码,完整跑通一个 Slack 克隆。更重要的不是结果,而是他展示了一种正在成型的新工作范式。

一个开发者,用Next.js、GPT-4o和一堆“过度工程”,真的做出了会记得你生活细节、能隔三天接着聊的AI朋友。这不是情感噱头,而是一套可复用的AI应用范式:记忆、人格、结构化输出、真实感对话,全都落地了。

Patrick Dougherty在创业过程中推翻整套产品,转而用AI Agent重构系统。这次分享不是概念宣讲,而是来自真实生产环境的教训:什么才算Agent、为什么“会想”比“知道多”更重要,以及哪些常见做法其实在拖垮Agent表现。

这篇文章还原了Cohere工程师Shaan Desai关于“企业级LLM Agent如何真正跑起来”的一线经验,从框架选择、单/多Agent策略,到安全、评估与失败治理,揭示了为什么大多数Agent原型很炫却难以规模化,以及Cohere如何把这些教训固化成产品North。

基于Juan Peredo一年半构建生成式AI应用的真实经验,这篇文章系统梳理了从架构复杂度、模型部署、评估体系,到Agent成本与可观测性的关键教训,帮助开发者少走弯路,把GenAI真正落地为可靠产品。

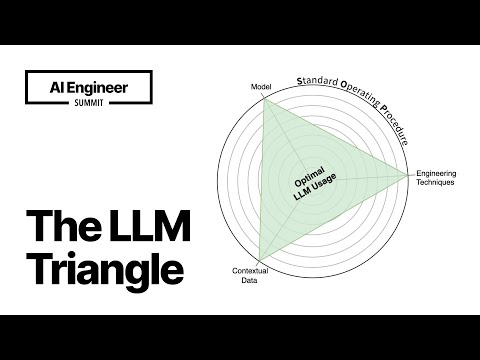

这场演讲并不是在教你“怎么调Prompt”,而是试图回答一个更难的问题:为什么90%的LLM应用死在生产环境。Almog Baku用工程师和创业者的视角,提出了“LLM三角”方法论——模型、工程技术、数据,在SOP的约束下协同工作,才可能构建稳定、可复现的AI应用。