为什么Agent的大脑需要一本“作战手册”:从本体论到Graph RAG的实战收益

Neo4j 的 Jesús Barrasa 在这场分享中提出了一个反直觉但极具实践价值的观点:要让 AI Agent 更可靠,关键不只是更大的模型,而是一套清晰的“知识作战手册”——本体论。通过将本体论引入 Graph RAG,他展示了如何在构建和检索两个阶段显著提升 AI 应用的质量与可控性。

Neo4j 的 Jesús Barrasa 在这场分享中提出了一个反直觉但极具实践价值的观点:要让 AI Agent 更可靠,关键不只是更大的模型,而是一套清晰的“知识作战手册”——本体论。通过将本体论引入 Graph RAG,他展示了如何在构建和检索两个阶段显著提升 AI 应用的质量与可控性。

这期《AI Daily Brief》提出了一个正在快速升温的新概念:上下文工程。它不再纠结一句提示词怎么写,而是关注如何为大模型和智能体持续、系统地提供正确的信息环境。文章将解释它为何出现、与提示工程的本质差异,以及它为什么可能成为下一阶段AI应用的核心能力。

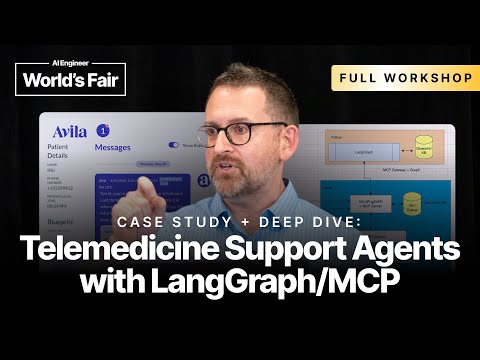

这是一场来自一线实践者的分享,讲述如何在真实医疗场景中构建AI支持代理。演讲者不仅展示了LangGraph/MCP在复杂流程中的价值,也反复强调了边界、责任与工程取舍。

这篇文章深入解读Vectara推出的开源项目 open-rag-eval,解释它为何要在没有“golden answers”的情况下评测RAG系统,以及背后的研究方法、关键指标和实际使用体验,帮助RAG开发者真正理解并优化自己的检索增强生成流水线。

在RAG几乎成为标配的当下,评测却悄然失真。AI21 Labs的Yuval Belfer和Niv Granot通过真实案例指出:我们正在为错误的基准优化系统。本文还原他们的核心论证,解释为什么主流RAG评测无法反映真实世界,并介绍一种以结构化数据为中心的替代路径。

这期视频解释了一个看似底层、却将深刻影响AI应用速度的事实:MCP(模型上下文协议)已经成为Agent世界的事实标准。通过OpenAI态度转变的关键节点,视频揭示了为什么这场“工具之争”在真正开始前就结束了,以及这对普通用户意味着什么。

Roy Derks在这场演讲中提出一个被严重低估的观点:AI Agent的能力上限,往往不是模型或框架决定的,而是由工具(Tool Calling)决定的。他结合自身创业与工程经验,系统讲解了为什么工具不是“管道”,而是AI应用层最重要的资产。

这场来自 TraceLoop CEO 的分享,用一个极其务实的视角解释了:为什么生成式 AI 的可观测性问题,不能从零重新发明,而应该建立在 OpenTelemetry 之上。你将理解日志、指标、追踪在 LLM 应用中的真实价值,以及 OpenLLMetry 如何把这些能力“自动”带入现有观测平台。

许多团队投入大量精力做LLM评估,却依然在生产环境频频翻车。本文基于AI Engineer的一场演讲,解释为什么常见的评估体系会“看起来很好、实际上没用”,以及如何通过持续对齐评估器、数据集和真实用户需求,让评估真正产生价值。

开源工具一抓一大把,OpenAI却愿意为生成SDK付出六位数美金?在DevDay的这场Community Spotlight里,OpenAI工程师和Stainless把话说透了:真正值钱的不是“生成代码”,而是那些你以为理所当然、却最容易翻车的工程细节。