DeepMind研究副总裁罕见定调:Frontier AI不是更大的模型,而是更聪明的系统

当所有人都在追逐更大的语言模型时,DeepMind研究副总裁Raia Hadsell却在台上反复强调:真正的Frontier AI,并不等于“再堆参数”。这场演讲释放了一个清晰信号——下一阶段的智能竞争,方向正在悄然改变。

当所有人都在追逐更大的语言模型时,DeepMind研究副总裁Raia Hadsell却在台上反复强调:真正的Frontier AI,并不等于“再堆参数”。这场演讲释放了一个清晰信号——下一阶段的智能竞争,方向正在悄然改变。

如果你以为 AIE Europe 的主旋律是更大的模型、更强的算力,那你会完全看错。从 Google DeepMind 到 OpenClaw,这一天反复出现的关键词只有一个:工程。不是炫技,而是如何把 AI 真正变成可用、可控、可规模化的系统。

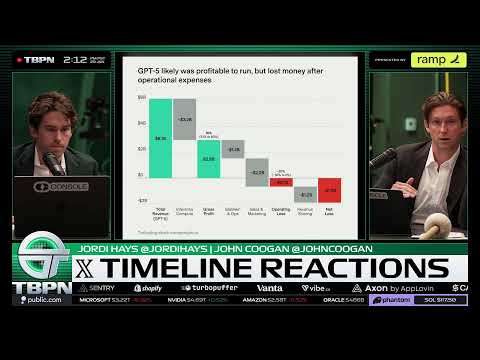

这期 TBPN 最反直觉的信号只有一个:OpenAI 正在系统性结束“副本任务”。从内部团队收缩,到和 TPG 组建合资公司,再到 mini / nano 模型路线的明确化,所有零散动作突然拼成了一条清晰主线——AI 公司不再炫技,而是开始算账了。

2016 年那场 4:1 的胜利,表面是 AlphaGo 击败李世石,实际上却悄悄改写了整个 AI 研究范式。十年后,DeepMind 核心研究者回顾这次转折,揭示了一个更反直觉的事实:今天的大模型浪潮,很多关键思想都源自那次“下棋”。

当所有人还在纠结要不要微调模型时,YC 的一场对话直接掀桌:有团队用更便宜、更快的方法,让大模型在不微调的情况下持续变强。这不是提示工程的小修小补,而是一种可能改写 AI 应用范式的新思路。

当所有人盯着大模型参数和算力军备竞赛时,苹果却悄悄收购了一家做语音与视觉的以色列AI公司。这期 TBPN 把苹果、微软、Meta、特斯拉和 DeepMind 的最新动作串在一起,透露出一个被低估的信号:下一阶段的 AI 胜负,不在模型,而在“产品化能力”。

如果你只把这期节目当成一次“财报串烧”,那你就错过了真正的信号:微软、Meta、特斯拉、苹果、OpenAI正在用完全不同的路径,争夺同一件事——AI时代的控制权。这不是短期股价故事,而是一场关于模型、分发、算力与数据的长期博弈。

如果你还以为基因AI只是“预测一个位点的作用”,那这场圆桌会直接把你认知掀翻。DeepMind最新发表在《Nature》的 AlphaGenome,不是更准一点的小模型,而是一次野心极大的尝试:用一个统一模型,把DNA序列直接映射到功能世界。

如果你只把这期 TBPN 当成一场科技闲聊,你会错过一个关键信号:2026 年的科技行业,正在从“谁的模型更大”,转向“谁能真正跑起来、赚到钱、撑住成本”。从达沃斯的权力更替、AI Agent 的集体焦虑,到苹果和 Anthropic 的隐秘转向,这期节目信息密度极高,几乎每 10 分钟就扔出一个行业拐点。

这场来自Google DeepMind的现场分享,罕见地把视角从模型参数转向“如何真正构建产品”。Kat Kampf与Ammaar Reshi结合Gemini 3 Pro的发布,讲述了DeepMind多年技术积累如何转化为可用、可演示、可设计的AI能力。