没有CS背景,也能走向AI PM:一位Google AI产品负责人的真实路径

这是一场来自Google AI产品负责人的坦诚对话。她没有把AI PM神秘化,而是反复强调用户、概率思维与跨团队协作的重要性,并分享了自己如何在高度不确定的环境中做产品决策。这篇文章提炼了视频中最有价值的方法论与真实经验。

这是一场来自Google AI产品负责人的坦诚对话。她没有把AI PM神秘化,而是反复强调用户、概率思维与跨团队协作的重要性,并分享了自己如何在高度不确定的环境中做产品决策。这篇文章提炼了视频中最有价值的方法论与真实经验。

Meta 发布 Llama 2,看起来像一次常规模型升级,实际上却在动摇整个 AI 行业的地基:一个性能逼近 GPT-3.5、完全开源、可商用、还被微软云原生支持的大模型出现了。这不仅是技术更新,而是一场关于“谁掌控 AI 未来”的路线之争。

Lex Fridman 通过 TensorFlow Playground 的可视化实验,展示了神经网络在不同结构与超参数下,如何逐步学会(或学不会)复杂数据分布。短短几分钟的视频,揭示了模型容量、特征工程与直觉理解之间的深刻联系。

Lex Fridman通过“苦涩教训”回顾了70年AI发展史,指出真正推动指数级进步的不是聪明算法,而是能持续放大算力的通用方法。视频从历史案例出发,讨论了算力、算法、数据与未来计算范式之间的张力。

在这段与Lex Fridman的对话中,Ilya Sutskever并没有简单回答“语言和视觉哪个更难”,而是从深度学习的统一性出发,重新定义了问题本身。他分享了对计算机视觉、自然语言处理和强化学习之间关系的深刻判断,以及未来AI可能走向“单一架构”的大胆预期。

在这段与Lex Fridman的对话中,Yann LeCun系统阐述了他对“人类级智能”和AGI的怀疑态度。他强调:任何声称接近人类智能的系统,都必须接受严格、可复现的基准测试。比起宏大叙事,LeCun更关心可验证的任务、交互式环境,以及机器真正“学会如何学习”的能力。

在这期Lex Fridman播客中,计算神经科学家Tomaso Poggio回顾了自己从童年物理兴趣出发,到研究大脑与机器智能的学术旅程。他围绕视觉系统、神经网络与学习机制,提出了关于“智能为何如此困难”的深刻洞见。

在这期Lex Fridman播客中,深度学习三巨头之一Yoshua Bengio回顾了自己对神经网络的长期思考。他指出,当前AI的核心瓶颈不在于模型规模或数据量,而在于信用分配、常识先验和因果理解等更接近人类智能的机制。

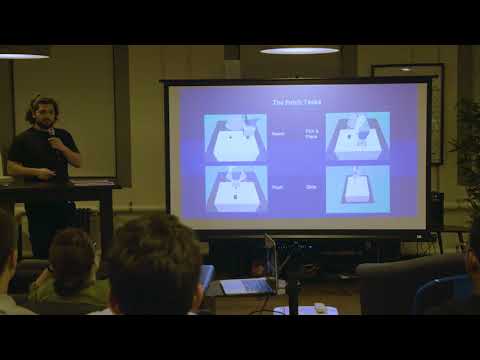

如果你以为“学会世界模型,强化学习就起飞了”,这场 OpenAI 内部分享会当头泼了一盆冷水。Alex Botev 用真实的机器人实验告诉你:模型不是越强越好,关键在于怎么用。更重要的是,他给出了一条现实可行的折中路线。

当机器人能灵巧地转动物体,却因为摄像头轻微挪动就“失明”,问题不在控制,而在视觉。OpenAI 2018 年的一次实习分享,揭开了一个反直觉事实:再强的神经网络,也会被错误的视觉假设拖垮。