模型没错,是你不会提问:一位AI工程师的提示工程真相

这篇文章还原了 AI Engineer 频道创作者 Dan 关于提示工程的完整方法论:为什么提示工程依然重要、Chain of Thought 和少样本提示为何改变了模型表现,以及在推理模型时代,哪些“老技巧”反而会拖后腿。读完你将知道,问题不在模型,而在你如何与它对话。

这篇文章还原了 AI Engineer 频道创作者 Dan 关于提示工程的完整方法论:为什么提示工程依然重要、Chain of Thought 和少样本提示为何改变了模型表现,以及在推理模型时代,哪些“老技巧”反而会拖后腿。读完你将知道,问题不在模型,而在你如何与它对话。

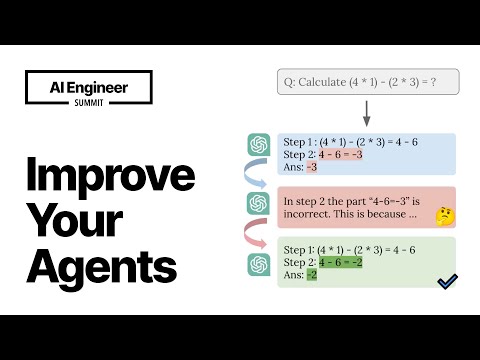

这场来自哥伦比亚大学研究者的演讲,试图回答一个被反复提起却很少被认真拆解的问题:什么才是真正的AI Agent,以及我们该如何系统性地提升它们的能力。视频从基础定义出发,结合学术研究,深入讨论了大语言模型在Agent场景下的自我改进、推理优化与测试时计算等关键方法。

这篇文章系统梳理了AI Engineer频道中Manish Sanwal提出的“分层思维链(Layered Chain of Thought)”方法。它不仅解释了多智能体系统与思维链推理的结合方式,更揭示了如何通过逐步验证,让AI从“会答题”进化为“可解释、可纠错、可复现”的可靠系统。

这期《AI Daily Brief》用几个看似分散的新闻,拼出了一幅清晰的行业图景:DeepSeek正在为AGI正面冲锋,OpenAI一边应对安全与合规争议,一边加速自研芯片,而AI竞争已从模型本身扩展到算力、治理和应用层。本文带你抓住这些信号背后的真正含义。

Anthropic被曝出到2027年冲击120亿美元、甚至345亿美元营收的激进预测。这不仅是财务故事,更揭示了它押注API、代码生成和治理加速的独特路径,以及与OpenAI截然不同的竞争逻辑。

Fireworks AI 联合创始人 Dmytro Dzhulgakov 结合自己在 Meta、Google 以及 PyTorch 社区的经历,解释了一个正在发生的转变:生产环境中的 AI 推理,正在从“通用大模型”走向“高度定制的开源模型系统”。这场演讲不仅讨论了成本与性能,更揭示了下一代 AI 产品的真实形态。

DeepSeek R1并非横空出世,而是长期工程积累的集中爆发。本文拆解其在训练效率、模型架构与强化学习推理上的关键解锁,解释为何它以更低成本逼近o1级能力,并由此改写AI应用的成本曲线。

这篇文章还原了YC Decoded对“Scaling Laws”的完整叙事:从GPT-2到GPT-3确立规模定律,从Chinchilla纠偏“只堆参数”的误区,再到OpenAI用推理模型与测试时算力开启新一轮扩展路径。你将理解:为什么AI并未撞墙,而是正在换一条更陡峭的增长曲线。

过去一年,AI 编程工具层出不穷,但 Greg Isenberg 的这期实战视频抛出了一个反直觉结论:真正拉开差距的,不是你用不用 AI 写代码,而是你敢不敢把“从想法到上线”整个流程都交给 AI。这一次,他们用 Cursor 把这件事做到了极致。

当“AI智能体”还停留在技术圈热词时,主流商业世界已经开始行动。通过《华尔街日报》报道的5个企业案例,以及Google的一份关键白皮书,这篇文章还原了2025年企业部署AI智能体的真实起点、边界与方法论。