AI四大战争最新战况:GPU不再是护城河,真正的洗牌刚开始

Inflection 和 Stability AI 同时“失速”,Claude 3 却让大量用户直接抛弃 GPT-4——这期播客更新了一个残酷现实:AI 竞争已经不再是谁模型更大,而是谁站在对的战场。四大战争的胜负,正在改写所有创业者的生存概率。

Inflection 和 Stability AI 同时“失速”,Claude 3 却让大量用户直接抛弃 GPT-4——这期播客更新了一个残酷现实:AI 竞争已经不再是谁模型更大,而是谁站在对的战场。四大战争的胜负,正在改写所有创业者的生存概率。

这是一家仅成立一年的欧洲AI创业公司,却频繁被拿来与OpenAI对标。通过与Mistral AI CEO Arthur Mensch的深度对话,这期播客揭示了Mistral在开源、效率、分发与监管上的一整套反直觉选择,以及这些选择背后的技术与商业逻辑。

LangChain CEO Harrison Chase 讲述了这个开源项目如何在 ChatGPT 前夜诞生,并在高速演进的 AI 浪潮中不断重塑自身定位。他分享了做开源框架的取舍、AI Agent 的真实瓶颈,以及 RAG、微调等热门技术背后的冷思考。

不是科幻,也不是未来预测——已经有超过五分之一的美国人相信,AI能拍出比人类更好的电影和电视剧。更危险的是,年轻人比你想象中更快接受这一点,而巨头们已经在企业端悄悄完成合围。

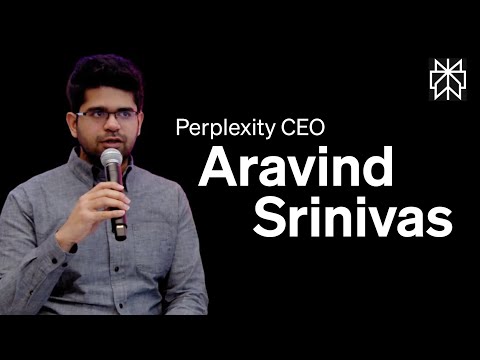

很多人以为 Perplexity 是“又一个 AI 搜索引擎”,但 CEO Aravind Srinivas 在 Stripe 的这场对话里反复强调:他们赢的不是模型,而是推理方式、工程文化和一系列看似无聊却致命的选择。更反直觉的是,Perplexity 并非从搜索起步,却可能最早重塑搜索的终局。

在这期 No Priors 播客中,Pinecone 创始人兼 CEO Edo Liberty 回顾了向量数据库从“没人理解”到生成式 AI 核心基础设施的全过程,解释了 Embedding 与 RAG 架构的真实价值,并分享了 Pinecone 在产品形态、开源策略和未来方向上的关键判断。

在这期 No Priors 播客中,Notion CEO 伊万·赵系统阐述了 Notion 的长期愿景:用“软件积木”取代碎片化应用,让 AI 成为人人可用的认知与创造工具。他分享了 Notion AI、Q&A、日历背后的方法论,以及他对未来十年计算形态的关键判断。

纽约时报起诉 OpenAI,本以为是一次传统媒体维权,却被 OpenAI 反手指控“诱导模型复读”。这不是一场普通的版权纠纷,而是一次可能决定大模型训练合法性的世纪对决。

这期RedpointAI播客请来了Notion AI团队核心成员,系统讲述了Notion如何在极小团队规模下,快速交付AI Writer、Autofill和Q&A等产品,并在评估、提示工程和组织结构上形成一套独特方法论。

在 OpenAI 首届开发者大会上,一场看似“基础”的分享却抛出了一个让无数团队踩坑的真相:微调不是万能钥匙,甚至常常是最后一步。这场45分钟的技术演讲,实际上给出了一个极其清醒、反直觉的 LLM 性能优化路线图。