Gary Marcus:为什么深度学习缺的不是规模,而是常识

在与 Lex Fridman 的对话中,Gary Marcus 系统性地反思了深度学习的边界。他认为,当前 AI 最大的瓶颈不在算力或数据,而在缺乏“常识”和可解释的认知模型。本文提炼了他最关键的洞见、经典案例与争议观点。

在与 Lex Fridman 的对话中,Gary Marcus 系统性地反思了深度学习的边界。他认为,当前 AI 最大的瓶颈不在算力或数据,而在缺乏“常识”和可解释的认知模型。本文提炼了他最关键的洞见、经典案例与争议观点。

Jeremy Howard结合自己多年教学与研究经历,回顾了从Theano、TensorFlow到PyTorch与fast.ai的技术演进。他直言框架设计如何直接影响研究效率、新手学习曲线,以及整个生态的未来,并对Swift for TensorFlow给出了冷静而独特的判断。

在这期 Lex Fridman 的播客中,Gary Marcus 系统阐述了他对通用人工智能的核心判断:单靠深度学习远远不够。通过常识推理、语言理解、儿童学习和象棋等具体案例,他提出了一条更现实的路径——将深度学习与符号推理相结合,构建真正可靠的智能系统。

这是一场发生在2019年的对话,却精准击中了今天仍在争论的核心问题:为什么必须严肃对待AI风险?Dario Amodei与Daniel Dewey从历史类比、技术细节到个人经历,系统讲述了AI如何可能改变文明轨迹,以及安全研究为何必须与能力进展并行。

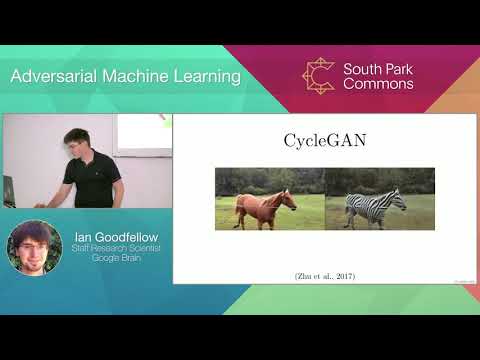

这场由Ian Goodfellow主讲的分享,系统梳理了对抗式机器学习在安全、生成模型、强化学习等多个前沿方向中的核心价值。演讲不仅回顾了技术爆发的背景,也坦率指出当前方法的局限,为理解“不可靠AI”的根源提供了难得的一手视角。

这场演讲并不教你如何训练一个模型,而是试图回答一个更难的问题:当我们谈论AI和深度学习时,真正的系统全貌是什么?Yang Hong通过“数据宇宙”的视角,拆解概念混乱、成本结构和被忽视的工程现实。

这篇文章梳理了机器人学大师Vijay Kumar在一次深度访谈中的核心思想:从他学生时代建造的巨型六足机器人,到今天在全球领先的无人机编队研究,再到对机器学习、自动驾驶和人机协作的冷静判断。你将看到一个工程师如何理解“美”、规模化,以及机器人真正走向现实世界的难题。

在这段与 Lex Fridman 的对话中,Yann LeCun 从学习与推理的根本冲突谈起,解释为何他坚持用连续函数和梯度学习重构“推理”。他借助人脑记忆结构、能量最小化与世界模型,描绘了一条不同于符号主义AI的长期路线。

在这段与Lex Fridman的对话中,fast.ai创始人Jeremy Howard给出了与主流路径截然不同的深度学习学习建议:不要停留在看论文或跑推理,而是亲手训练、微调大量模型,并且始终围绕你真正关心的真实问题。

在这期Lex Fridman播客中,fast.ai创始人Jeremy Howard回顾了自己从早期编程语言到深度学习教育与研究的完整路径。他分享了对编程未来、深度学习实践误区、GPU训练、学习率技巧以及fast.ai诞生背景的独特看法,揭示了为何“把复杂技术交还给更多人”才是真正的突破。